2025秋 课程号:AI300201

- 课程难度:中等

- 作业多少:中等

- 给分好坏:超好

- 收获大小:很多

| 选课类别:计划内与自由选修 | 教学类型:理论实验课 |

| 课程类别:本科计划内课程 | 开课单位:人工智能与数据科学学院 |

| 课程层次:专业核心 | 学分:4.0 |

本课程主要讨论机器学习的基础算法。具体内容包括线性回归与分类、性能评估、正则化、神经网络、无监督学习、决策树、降维方法、支持向量机、强化学习、逻辑、知识表示等。重点介绍机器学习算法的基本工作原理及其应用。该课程将理论与实践相结合,不仅夯实学生的理论分析能力还锻炼学生的动手能力,从应用问题出发理解机器学习算法的作用与价值,并力图反映机器学习研究的最新发展前沿。

- 课程难度:困难

- 作业多少:很多

- 给分好坏:杀手

- 收获大小:很多

- 难度:困难

- 作业:很多

- 给分:杀手

- 收获:很多

《史诗:太阳》

当太阳不再生长

太阳成熟

太阳止步不前

绿叶承担了本该

由太阳完成的部分

互相遮掩

互相隐瞒

互相

生长断裂的羽翼

春天,我们的果实鲜红

我们的果实其实并不应当出现

其实已经入夜,其实

绿叶笼罩了土地

太阳不动就会变得腐朽

太阳生锈,太阳

反而带来阴影

无数的英雄

鲜血白流

饱尝自相残杀的苦果

新生的太阳比古旧的太阳更加古旧

比任何的昨天更加冷淡

比任何的昨天更加腐烂

绿叶也会由于太阳而枯萎

由于太阳,一切

都是太阳的杰作,他的引力和光

同时占据着我们的伤痕

和我们的前提

无数的英雄,夸父们

跨过高山河流

滔滔黄河,为海洋输送泥沙

输送富饶的聚落

痛饮一口,迈开你的腿,前进

一旦想要停下就会掉入洪流

前进,前进

变成小小的山丘

变成地火

直到最后,所有人都忘了

如何放声歌唱

《史诗:黑夜》

黑夜并不代表阴影

黑夜什么也不代表

什么也不,只是一个能够睡眠的地方

这里的阴影来自白天

无尽的灯光和火烛在风中飘摇

在风中,吞食黑夜的遗体

舔舐每一寸骨殖,每一寸有用的东西

黑夜只是白天的燃料

在没有人知道的地方耗竭

黑暗的房间里一只大象

黑暗的房间里盲人摸象

其实你们什么都知道,不过

你们默不作声

并命令大象同你们一起

大象发出生长的声音,呼吸沉重

急促的心跳声传出,不知道

来自大象还是你们

失眠的黑夜里一盏灯火

失眠的黑夜里一颗眼睛

嘘,从天使的床上落下一根

淡黄的羽毛

被翅膀包裹的眼睛,最后一颗

透过无法避免的缝隙

看到

注定的太阳

是的,他能看见

翅膀的中央有一滴水

黑夜燃烧,黑夜引火自焚

黑夜在世界上永远消失

《史诗:西西弗斯》

有时,幸福只是一只飞翔的小鸟

溢出歌声的喷泉和竖琴

一层层白云堆叠,一层层

并不纯净的黑土

短暂地记住他的脚印

有时,幸福只是一片掉落的树叶

燃烧

露出秋天的笑容

保持笑容

地球一样巨大的石头

地球上所有的水

白云堆叠的浪花,拍打树干

留下雪一样的盐粒

一根力的箭矢违抗一切

肩膀,胳膊,腿,到山上去

不断的灰尘,淹没黑土构成的大地

和水一起,让世界只剩石头和山峰

雪,从一层又一层来

压在没有叶子的树上

没有小鸟的树,没有

孤单的湖水上一棵树

有时,幸福只是一块石头

被定义,被用于惩罚,被周而复始

掉落吧,但不要停在最开始的地方

一直向下,冲撞你所痛恨的,粉身碎骨

让他获得自由

让他走在石头上,活在石头周围

获得石头,成为石头,继续石头下去

然后,石头,然后

《史诗:土地》

不,妈妈,我们还没有死

我们只是躺了下来

冰覆盖着一切

冰下有一粒种子

妈妈,我们都要去很远很远的地方

远到我们也不知道的地方

我们不知道,我们一无所知

我们一旦启程就无法停留

不,妈妈,不要把我们比做蒲公英

他们在风的驱使下并不自由

树发芽

树把根扎入泥层

妈妈,我们生来就是为了流浪

流浪到我们应该流浪的地方

纵使这眼泪苦涩,纵使粉碎

我们必须进军,为了无尽的财宝和石碑

纵使凋零,纵使绿叶变黄

不,妈妈,我们已无法回头

树生长枝叶

树在风中飘摇

妈妈,我们不曾赤脚走向麦田

忙于得到和失去,不曾丰收

星辰从天边坠落,悄无声息

桌上的符号,那是一种奇怪的文字,跳动不止

沉溺其中,为荣名而无法自拔

不,妈妈,我们忘了自己是谁

树被摘光

树被连根拔起

不,妈妈,不

这里没有供我们安睡的地方

祖辈长眠于此,父辈长眠于此,我们焚化于此

妈妈,我们除了遗言一无所有

遗言也一样,也不属于我们

它们将在昏暗的天空中盘旋

然后太阳升起,然后消失

不,妈妈,那是另一些我们

《史诗:野花》

我爱你,但我必须离开

远走,遗忘,杳无音讯

这山丘太大,容不下我们的细小

容不下构成自己的土石

雨水蒸腾的那一刻

我们曾一同呼吸

痴迷于那种气味,痴迷于美

直到太阳驱散了云层

一种美诞生在石头缝中

她不断生长,并证明自己的存在

其实她在寻找土地,寻找自己的花瓣

风来了,风

淹没了我们的回声

从一个远方到另一个远方

从一个远方到更远的远方

这洪流浩大,这洪流伟力无穷

我们相爱却不自知,我们身不由己

石头缝中生长出一种美

她违抗着山丘和太阳,肆意呼吸

土地在哪里?雨水在哪里?

只剩灰尘飘飞,只剩羽毛鲜红

为了爱人的苦痛而忍受一切

为了爱人的欢笑而承受一切

数着彼此的骨头,放声大哭

我们紧紧相拥,除了彼此一无所有

这山丘太大,抹平一切细小的枝叶

在太阳的定义下这就是唯一

我爱你,但我必须离开

我爱你,所以必须离开

《史诗:河流》

水上漂来了一段根须

河畔曾经有一个孩子

流向远方,流向大海

背叛所有的小麦和磨盘

蹲在河畔抽烟的孩子

流向黑夜死亡的坟墓

那里的孩子众多,泛滥成灾

一张张黑纸

一张张不同弯曲的脸

兜售自己的春天,红花绿草

跳过盛夏抵达严冬

竖直生长的牢笼

竖直的灰色刀锋

劈开天空和大地,劈开云层

劈开河畔龟裂的树桩

黑色的雨水,黑色的孩子和马

躺在河畔

梦见谷仓和草地

河畔上失眠的孩子

河中央永不停息的船

转过身去,背对黄土

背对我们曾经的家园

是的,我们的使命只有前进

一万根桨,只听命于舵

陷入湍流下深深的河床

河畔不曾有一个孩子

《史诗:长子》

我要抛弃亿万人的血脉

对他们视若无睹

他们诞下我,以及我的原罪

诞下一切苦痛的源头

我要用蜡片织成一双翅膀

在夏至正午飞跃大洋

让每一个心存希望的水手

沉溺于大海捞针

我要毁灭所有的遗产

让土地无人继承

留下无尽的稗草,生生不息

继续繁殖过剩的悲剧

我要对山上的羔羊

举起献祭的屠刀

牺牲一切,纵使没有必要

把鲜血溅满所有的门框

我要亲手采摘荆棘

编成失败的皇冠

我还必须张开双手

我是注定被钉死的怪物

《史诗:天使》

琴声渐响,钟声渐响

不要听信碑文上的誓言

被许多强手拖着,跋山涉水

知晓一切之人,背负太多

长出眼睛,长出更多眼睛

透过黑暗,看到更多黑暗

羽毛直直坠落,掷地有声

祂的手上有一根刺

这星光刺眼,这露水浑浊

故事的结局早已注定

太阳和光辉将统治一切

包括天空也包括泥土

祈祷,流血,祈祷

祈祷像石头,流血像骨头

放声歌唱,拾起那片黯淡的羽毛

琴声渐弱,钟声渐弱

《史诗:火》

麦野地刮起的黑风

第十灾,最后一灾

一团模糊的东西,噼啪作响

不是花朵也不是木头

流出血来

流出血来

在无尽的太阳面前我们只有血

为了光明不顾一切

为了光明而枉死

为了光明而背弃生命

胜利的人

胜利而走向天堂的人

忘记了那片地上

有一团模糊的东西

一团土灰

让神像蒙尘

把自己烧得焦黑

举起刀锋

却不知道要挥向谁

愤怒而复仇的怪物

愤怒而不自知的火山

他不知道,他们都不知道

火的中央有一滴水

2026.3

参考文献:海子《亚洲铜》《阿尔的太阳》《单翅鸟》《黑风》《活在珍贵的人间》《明天醒来我会在哪一只鞋子里》《黑夜的献诗》《太平洋的献诗》《西藏》《幸福的一日——致秋天的花楸树》《泪水》《九月》《面朝大海,春暖花开》《春天,十个海子》

写在前面:我对这门课本身没有任何意见,王老师和张老师都是很会讲课的老师,讲得非常好。但是这门课在设计上有几个令人不悦的地方:

1.不设置考试。没有考试的设计看似是为同学们减轻备考压力,但其实在无形中给同学们增加了更多的压力。本门课程的所有分数评定均来源于实验和作业,抛开助教的个人喜好不谈,从代码补全到原理分析,再到实验报告的撰写,整个流程都充斥着大模型。我并不排斥大模型的使用,但如果一项任务的全流程都有大模型的介入,我们真的能看出来这是学生本人的能力还是大模型的托管吗?同时,赛博炼丹本身就是一个随机性极强的东西。虽然助教们一次又一次地强调我们会看报告有没有体现个人的思考,有没有合理性,但实际上如果实验做出来的效果不好,分析再多也没用。总之由于种种原因,这门课在本身又硬又难的前提下,给分很大程度上是吹风机我说这话肯定会被喷是所谓“生活不如意”,但确实是这样,我们拿到的分数很大一部分是运气使然,无论好坏。虽然但是如果真考试了可能就变成机器学习A了。给分程度倒也不吹风机,因为有水平的一定能拿高分,而且课程本身已经是AI领域非常前沿和创新的课程了。

2.神秘的替代关系。这门课能够高替机器学习A,所以有很多大三的同学来选这门课,使得本就不够用的优秀率更是雪上加霜,以至于最后助教(可能)不得不进行面向优秀率的保序变换。我不知道是谁设计的培养方案,你吗

3.自学量太大。Fly,B**ch,老生常谈。这门课自学量不大本身就是不太可能的,但是这也太吓人了。学到最后我得出了一个奇怪的结论:人工智能作为一个专业也许根本就不应该招收本科生。

总之这门课算是完了,几家欢喜几家愁,我看评课社区里晒分的人还挺多的,哈哈。

2026.3.9

亲爱的,我又一次失眠了,我觉得我需要给你一个交代,也给我自己一个交代。这门课对我的影响太过深远了。

在Lab1和Lab2出分之后我删除过一次这篇评课的所有内容,理由很简单——我认为我努力了很多,但是结果却让我大跌眼镜。我听着助教在讲台上滔滔不绝地谈论着实验到底应该如何开展,报告应该怎么写,变量应该怎么控制,但这些东西明明可以早一点讲清楚。这门课是给大二同学开设的,而同学们在大一根本就没有接触过这些东西,同样也包括python。我们能怎么办?我们根本就不知道自己接下来需要什么样的能力,到达什么样的境界才能从从容容地学习和完成任务,这在我上了一节课的计组之后又一次应验了:李曦老师直截了当地告诉我们没学过数电的不要来选这门课,我被他吓得直接退掉了计组。这也是我一直以来的毛病——认为自己还不够好,然后陷入长久的焦虑、内耗以及超负荷工作。这是一个不好的习惯,但它的出现是有原因的。

这门课出分后我的第一个念头其实是对不起你。你让我帮你复习数据结构A,我想尽了一切办法给你讲解不会的知识点,却被某个神秘老师的出题品味来了当头一棒——最后的结局并不好,你卡绩了。当时我们走在西区前往1958的路上,我明显感觉到你的心情并不好,于是点了个蛋糕,然后尽一切可能给你讲接下来的ICS,试图分散你的注意力,但ICS同样也是一场灾难——由于AIDS置课的久负盛名,许多同学纷纷转走,反而导致原来班级的压力小了下来。你又一次被命运做局了。

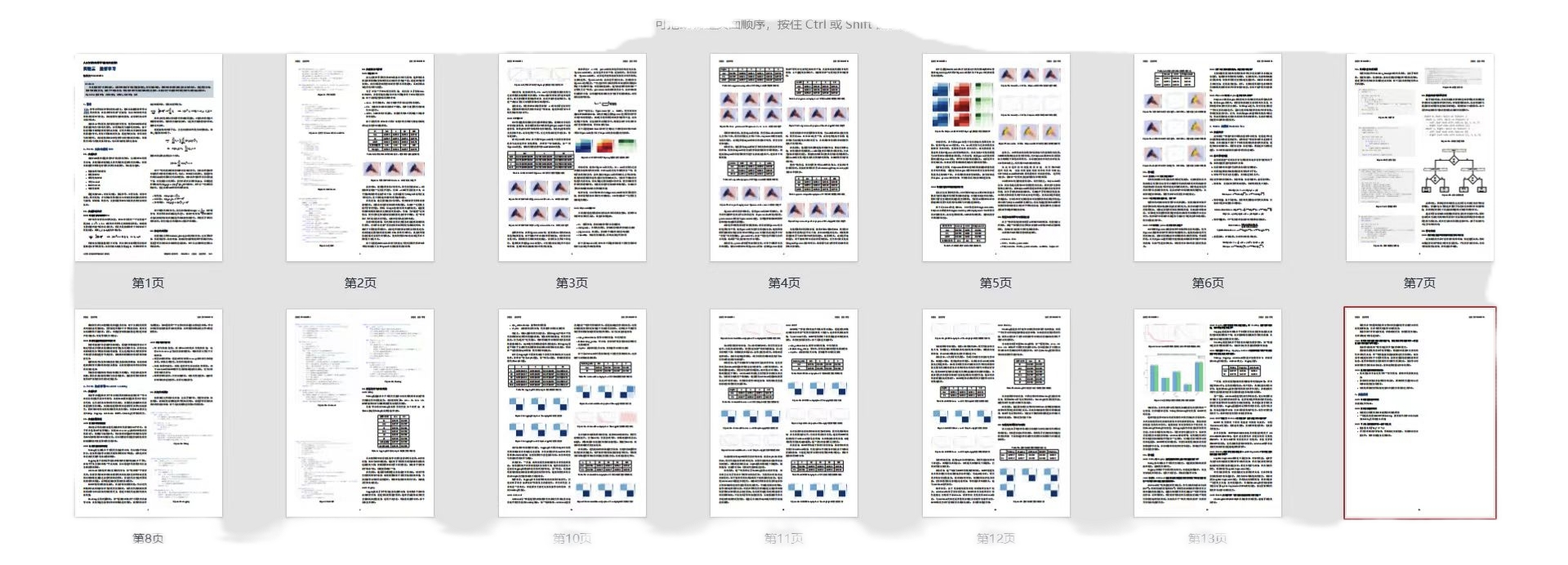

然后就是AIML的Finalproject.当时我非常自信,觉得只要投入足够的努力,一定能获得一个至少看上去还可以的分数的。我还记得当时你在复习遗传学,我就每天躲在宿舍里敲代码,跑代码,然后分析数据。我从1月20号左右一直工作到2526号,前两天熬到凌晨断电,到后来发现自习室不断电了,就抱着电脑跑到自习室去跑代码。自习室还有一些同学在打游戏,人也比较杂,我怕电脑出什么事,就一直看着,即使代码它自己也能跑。五子棋的训练和测试都很慢很慢,3000轮的训练在我那台略显寒酸的笔记本上要跑大概半小时。我为了提高训练效率,同时开着四五个终端在跑代码,跑得电脑的散热风扇嗡嗡响——其实我应该多和你见见面或者用用你的电脑,这样也许我能多跑几组实验。

实验要求写了5条,只有一条对模型效果做出了要求。这让我以为这是一场以思考和报告为主要给分点的实验——我在Lab2中就是吃了这份亏,当时我的报告写得很草率,调参的5分助教一分都没给我,理由是“感觉你是乱调的”,而最终结果我只拿到1分,理由听起来更扯:“结果没有带图”。我在写报告的时候认为我在调参过程中已经展示了图像,没必要再展示一遍。所以我把任务的重心放到了报告上。在跑模型的时候,我同时还写报告。

我试了很多种方法,当然这些东西绝大多数都是deepseek帮我写的,但最后我发现最厉害的模型居然是基础模型?好吧,有点出乎意料。但是整门课结束后我发现并非如此——有些使用其他架构的组甚至能做到和助教的baseline对弈100%胜率。我去看了他们的代码,使用的是Resnet,这是我没有想到的架构。同时,他们的训练轮数有几百万轮,而我压根就没有往这方面想,原因有很多,我一个一个说。

第一个原因是我在训练的过程中发现模型总是不收敛,loss持续不断地震荡。我把助教的框架整个喂给了deepseek,结果它告诉我助教使用的训练函数(明面上不需要我们做出修改的部分)犯了一个数学错误,并提供了修正的代码。我这次做了消融实验,在修改了那个训练框架之后,模型收敛的速度明显加快了,Loss甚至能到零点零几。我以为发现了重要的事情,并一直藏着掖着,想借此多加点分,但到最后似乎也没有成功。相反,由于模型很快就收敛了,我根本就没想到能把训练轮次加到1000000这种数量级。

第二个原因很明显:我没有算力。我那个破笔记本这么跑要五到六天才能跑到百万轮次。虽然助教给了一些获取计算资源的途径,但我用不了——我没有谷歌账号,也买不起GPU,也不想买——如果要靠这样的方式取得胜利,在我眼里是不公平的,那些没有算力的同学难道就不配做出好的结果吗?但最后的结果表明似乎是的——有算力就是比没有算力强,就算不做1000000轮训练,有算力的实验速度也要远远快于没有算力。

第三个原因则是完完全全来自我自己——我太累了。我已经连着熬夜五六天了,有几天是昼夜颠倒。我走在路上都感觉心脏不舒服。我真的没有动力了。加上我们后面还要打美赛,需要一些时间来准备,我草草结束了实验。总评出来以后我一直在想:如果当时能够再多想一步会不会更高?万一再换一个方法就能成功了呢?可惜没有如果。打完美赛我们吃了一顿费比欧,那可以说是我那段时间最开心的时候了。

总评出来以后没多久,申助教在群里公开谢罪说自己给分也许有点太刻薄了,是的,这是事实。100分的表现分,其中50分都是baseline,而我们的模型对弈胜率只有0.001,50分全都扣完。这导致你又一次卡绩了——如果这50分能拿到哪怕5分,你可能就不卡了。这时候我才发现自己其实一直在做无头苍蝇的实验——在“必须用AC”的实验要求下,我一直在调整奖励设计和神经网络的架构,然后选胜率最高的模型。当我为这个模型胜率接近100而沾沾自喜时,似乎完全忘了这只是我的模型,而不是什么厉害的模型——可视化以后它有时还是会下到奇怪的地方。我其实没有完全忘记这一点,我在报告里专门说了模型的风格会影响相对胜率,但是对我们的得分似乎显不出来任何帮助。助教说只有体现思考量的报告才能得90+,我们的刚好90,也许我想的还不够多吧。

我后来又去问了一位大四的学长,他对这个实验提出了一个疑问:“CNN真的能理解五子棋吗?”我认为还是能理解的,毕竟CNN能提取局部特征,但它在这门课程中明显有一个更适合的位置,却被另一个又复杂又效果差的方法替代了。

亲爱的,我有时候在想是不是应该多拉上你一点,但转念一想还是算了。一方面,一个人做实验的思路是连贯的,不会存在意见不合,另一方面,这种熬夜五六天的痛苦还是少几个人承受为好。

虽然这门课的分数已经比隔壁那个套皮的数学课好了不知道多少万倍,我还是觉得很难受——我觉得我付出的东西值得一个更好的分数。我曾经说过命运给我什么我就拿着,拿走什么我就看着,但当我真正想要争取一些东西的时候,命运就会露出獠牙。我能怪罪谁呢?怪罪老师?怪罪助教?怪罪自己?很明显,我选择了最后一种。你劝我不要内耗,但是当你辛辛苦苦构建的一切被以一种不可否认的方式否认的时候,怎么能不痛苦,怎么能不自我怀疑?

也许我们会说,啊呀做科研也是这样的呀,你不经历失败怎么做出来成果的呢?是的,科研允许失败,但失败就意味着会有损失,有牺牲。小一点的,牺牲了自己的时间,精力,还有实验室的资源,中间的,比如这门课(如果当成一项科研),可以看成损失了分数,大一点的甚至会造成事故或灾难。我不是说做科研不好或者什么,但这门课让我对科研产生了一种恐慌:如果什么也做不出来,大家(或者更直白一点,老板)是会容忍你的试错,还是会想方设法压力你,甚至赶你走?我们总说过程重要,过程重要,在现实面前这是一种多么虚伪的说辞啊。没有结果,一切都白搭。同时,我也产生了这样一种想法:如此透支身体的熬夜在科研中比比皆是,我们究竟是在拿青春换文凭,还是拿生命赌明天?

更糟糕的是我看不到未来。我总说将来要在科大当老师,做永世轮回科大人,但这个愿望真的能实现吗?在所谓非升即走的体系中,真正能留下的连3%可能都没有。我真的能排到前百分之3?还是我真的很有科研能力?我不知道,亲爱的,我不知道。未来太欠定了。我们规划得再好,大多数时候也只能走一步算一步。

我们总说人在痛苦中成长得更快,其实错了,人在痛苦中反而成长不了。我这两天就可以说是在痛苦中,以至于你叫我出去吃饭的时候我一点心情也没有。这并不是成长,亲爱的,这是一种衰老。你爸妈跟我说你是被惯大的,觉得你有点娇气,其实我觉得这也挺好的,你敢于去做一些事情,而我却总是畏畏缩缩。这和我的经历有关系——我的勇敢总是以被压制而收场,我失去了鼓起勇气的勇气。这让我想到阿德勒心理学,它认为人的过去不重要,怎么看待过去才重要。错了,人的过去是重要的,过去本身就在塑造人的认知。

这个学期我们还要上深度学习,可能需要更多的精力,更高的算力和更难的知识,这让我感到心力交瘁。我累了,亲爱的,我还有早八的体适能。

今天是你的生日,亲爱的,祝你生日快乐。忘掉这门课吧。海子曾经说过,没必要痛苦地提起他们,没必要忧伤地记住他们。

2006.3.9,深夜

9.30 作业文档看破防了孩子们

10.1 孩子们我才想起来这课能高替机器学习A,这下好了大三的史放到大二赤了。还有信智学部的同学一定要赶紧学会科学上网,不然很麻烦。

10.20 HW1这周日交,用到了神经网络的反向传播,其中有一个非常难懂的跨层梯度计算,但下周一才讲。这个故事告诉我们AI的学生不自学只能死翘翘。(后来延了一周ddl)

想给这课评8.6分,因为我自己已经有1.4了

11.30 跪了孩子们,被Lab2肘击的时候被Lab出的分后入了。

这课的同学赤石助教赤石,就连老师也有点赤石,感觉就是大家互相喂答辩吃()

不过老师讲课讲得很好,助教也挺负责的。只能说内卷过于严重了。

12.2 孩子们,不要怪罪助教。

12.9 孩子们,responsibility是后验概率,先验概率是\(\pi\),我是SB。

这下Lab2也完蛋了。

12.19 孩子们,hw3和lab3 有三份作业,3原来是三份的意思吗

12.21 世界末日了孩子们,这lab3真是健达奇趣蛋

1.6 孩子们,为什么Lab3没有线下验收

1.22 我需要一张显卡孩子们,我根本睡不着

1.22 熬穿了玛德

1.28 孩子们,这模型不对劲啊我靠,美酒了

2.1 号角已经吹响,什么的号角我也不知道

实验及作业评价

LAB 1.线性回归和分类器。先验难度D(Lab|t≤10.13)=9.5/10,后验难度D(Lab|10.30≤t≤11.30)=6/10,后验难度D(Lab|12.1≤t≤12.31)=3/10,后验难度D(Lab|1.1≤t≤2.1)=2/10

LAB 2.PCA降维和GMM聚类。先验难度D(Lab2|t≤11.30)=9/10,后验难度D(Lab2|12.1≤t≤12.31)=5/10,后验难度D(Lab2|1.1≤t≤2.1)=💩

LAB 3.集成向量树。先验难度D(Lab3|t≤12.31)=25/10,后验难度D(Lab3|1.1≤t≤2.1)=19/10

Final-Project: 难度D(Finale)=29/10

HW 1.难度D=0.6,计算量大,证明度P=5,肉编器指数RBQ=4,自学需求度SL=2

HW 2.难度D=0.8,计算量超大,证明度P=5,肉编器指数RBQ=6,自学需求度SL=5

HW 3.难度D=0.7,计算量大,证明度P=5,肉编器指数RBQ=4,自学需求度SL=2

指标说明:

先验难度表示在特定时间段内的主观难度,随时间条件会出现较大变化

证明度表示作业中证明题和代数推导题的量

肉编器指数指需要人力模拟机器学习中具体步骤的题量

自学需求度用于衡量作业中没学过的知识量,与自学所需时长成正比

实验内容及评价

Lab1

线性模型,主要涉及线性回归和逻辑回归。代码部分需要完成数据预处理、回归函数的前向后向传播、回归解析解、手写sigmoid函数、逻辑回归判断等,拓展内容包括但不限于特征工程、正则化等。

从事后诸葛亮的角度看,这个实验是非常简单的,但是对于一个0基础连python都没碰过的学生来说无异于徒手搓飞机。代码调试、特征设计、正则化效果评估等一系列的工作如果没有经验的话是很难开展的,包括后期写报告的时候要不要贴数据,贴多少数据也是完全没头绪。在Lab评估完之后我才发现有一个叫做消融实验的东西,而此前无论是课堂还是实验要求都没有明显的提及。正如某篇巨长无比的评课中所说:很多东西老师不教但需要你会。

我在实验报告上写了这个实验花费总计约50个小时,但是实际上可能没有这么长。50个小时纯纯是因为代码看不懂跑去恶补python,但最后还是越看越不懂,求助copilot才勉强完成。评价为还没落地就成盒。

Lab1出分以后有很多同学在pksq里写小作文,我当时虽然破防了但忍住了没写,事后想想也就那样了。

Lab2

PCA+GMM聚类,代码部分需要完成主成分分解和提取、责任矩阵计算、EM算法的更新等,拓展内容包括但不限于可视化设计、评估指标设计等。

这个实验的数据集是MNIST手写数字,PCA无疑是一个非常强大的武器,能够消除手写数字里的一些噪声,然而GMM在这个数据集上的表现并不好。一方面MNIST本身是一个有标签数据集,从这一点上来看似乎更适合用分类而不是聚类的方法进行分类;另一方面这个实验进行期间,我有幸了解了某位大四学长的一些工作,他向我展示了用神经网络对MNIST数据集进行分类,准确度到达惊人的99%,和我们惨不忍睹的聚类结果相比,令人忍俊不禁。GMM算法的数学原理难得要死,效果又不如神经网络,真是一场酣畅淋漓的赤石啊。

实验效果的评估用的是DBscore,这是一个评估聚类集中度的分数,但是原有框架中似乎并没有一个函数能输出这个分数,导致自己评估的话只能看图或自己写(修改大量文件),而且这个分数评估的可解释性似乎并不是特别好——特别是对于手写数字这种噪声很大的数据集。

除此之外,这个实验的验收还使用了某个神秘题库,1分钟做5道选择题,题库不公开。麻麻的我回答助教问题太紧张了直接干错了一个知识点硬伤,他问我责任矩阵是先验还是后验,我脑子一抽回答了先验。比起实验验收,这个东西似乎更适合出成考试题吧。

Lab2是我个人发挥最差的实验。超参没调明白,实验效果也不好,不过给分低的有点令人发指了。我在预处理阶段并没有除以255,但是似乎还是因此扣了5分。我不清楚是因为这个还是验收太差。验收也是一个神秘的东西,每个实验的验收方式都不太一样,像Lab2整了一个题库做选择题,创新性拉满但体验极烂。

Lab3

Lab3居然有三个实验。

决策树:easy,代码部分主要包括信息熵计算、结点分裂逻辑等。助教给了一堆提示,直接照着提示抄都能做完。

决策树最难的难点在于Jupyter环境的配置,其实根本不用开浏览器,本机下个拓展就能跑,还不用担心保存不下来。

如果要做更大数据集上的考量可以自己找数据,但是这个实验的数据没有用csv文件存储而是直接写成了矩阵(?)我还以为从哪能找到蘑菇的数据呢,搞半天原来要自己编。

集成学习:中等偏难,代码部分主要包括voting接口的编写、bagging(BOOTSTRAP采样)和Adaboost(SAMME)的主体实现,课上听讲了基本是能轻松补全的,没听讲狂按tab基本也差不多。

选做提供了GBDT和Staking。Adaboost是用后续分类器拟合前面的错误样本,GBDT更暴力,直接拿着后面的回归器拟合前面的残差(更准确地说是损失函数负梯度)然后梯度下降。这个东西如果直接用sk-learn库里面包装好的效果比手搓的会好得多(里面有二阶梯度和大量的超参可以调)。Staking旨在拿着基学习器产出的分类概率当特征训练一个超学习器,听着就有点猎奇不过效果还行。

SVM:难,代码部分包括手搓核函数、接口编写、网格搜索的超参表,整体比较蛋疼。

手搓核函数这个东西恰好是老师上课一笔带过的东西,虽然助教给了核函数该怎么写,但是一旦变成线性代数就会变得恶心。我花了半个小时才搞清两个矩阵怎么点乘,还有神秘的广播机制。

网格搜索里面助教给了几个超参表作为参考,但是如果想进一步探究超参选择的话就得自己调,感觉从这个地方能看出来到底有没有自己思考(是不是纯用AI)。

以及可视化的接口有点bug,grid网格搜索的类里面似乎没有一个以mean_test_score为关键字的变量?把变量名字改改加点判断逻辑(tab两下)就行。

本实验最大的槽点在于三个实验叠一起,我光报告写了三十多页。

Final-Project

助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。助教你睡了吗我睡不着。同学们你们睡了吗我睡不着。

我现在眼睛一闭就是那个五子棋,眼睛一睁就是那个神经网络,我调参调的都快心律不齐了,然后模型第一步给我下角上。不——这不是真的,这是演的,剧本,俩随机,线性模型假扮的。我不能接受,我心理委员呢,我Loss曲线从地上跳到天上了你知道吗?我喘不过气了,我喘不过气了,我喘不过气了,

\(\huge{\textcolor{red}{咕咕嘎嘎!}}\)

据说最终的评分涉及到模型互相对弈,究竟🦌似水手?

哇真的是太棒了我超爱机器学习的我已经迫不及待要选择隔壁的机器学习A来证明我对机器学习的爱了我真的很喜欢机器学习每当线性模型在权重上做出一步梯度的下降就算是熬夜到凌晨7点改代码的同学也不禁挺起了自己骄傲的秃头每当高斯混合分布通过责任矩阵展现无监督学习的奇妙魔力即使是ChatGPT也会露出无比温馨的笑容每当神经网络又一次做出了精准的卷积和池化就连联想LENOVOThinkBook也会使用自己的CPU为屏幕前的观众朋友们演奏一场精彩的风扇独奏我已经迫不及待要唱了你看又急一双鸳鸯熄在雨中那水面就像调参苦力头桌添我不闻模型三千几个能为我援只求百转千回为你许庆愿

传统的五子棋就是把五个子连成一条线好无趣好无聊而RL五子棋就是在传统的五子棋加入RL好好玩要爆了RL五子棋神经网络RL五子棋ActorCriticRL五子棋自我博弈RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优RL五子棋局部最优局部最优局部最优局部最优局部最优局部最优局部最优局部最优局部最优局部最优局部最优局部最优局部最优局部最优局部最优😡😡😡😡😡😡😡😡😡😡😡

我真的求你了别下到角上行不行我把reward都给你,我真的求你了别欠拟合行不行我把模型复杂度都给你,我真的求你了别随机都赢不了行不行我把CPU都给你,我真的求你了别下到角上行不行我把reward都给你,我真的求你了别欠拟合行不行我把模型复杂度都给你,我真的求你了别随机都赢不了行不行我把CPU都给你,我真的求你了别下到角上行不行我把reward都给你,我真的求你了别欠拟合行不行我把模型复杂度都给你,我真的求你了别随机都赢不了行不行我把CPU都给你,我真的求你了别下到角上行不行我把reward都给你,我真的求你了别欠拟合行不行我把模型复杂度都给你,我真的求你了别随机都赢不了行不行我把CPU都给你,我真的求你了别下到角上行不行我把reward都给你,我真的求你了别欠拟合行不行我把模型复杂度都给你,我真的求你了别随机都赢不了行不行我把CPU都给你,我真的求你了我把阳寿都给你,我

亲爱的,现在是公元2026年1月28日凌晨1点57分,我在这里和你说话。我知道你现在很困了,所以你可以缓一缓,不用立刻读完。没有看到也没关系,或者说没看到其实更好。

我知道这个学期让你焦头烂额。在神秘的不可抗力作用下,一门专业课被从大三放到了大二。也许从大一下学期的期中座谈会开始,命运的天平就已经开始不可逆地倾斜了。那次座谈会我去了,你没有去。当那份全新的培养方案摆在我们面前的时候,我就已经预感到大事不妙了。就像课上讲的一样,当数据不平衡时,直接猜测的准确率就可能会很高,数据越不平衡,这种现象就越明显。而根据我的身边统计学,中途易辙往往需要付出一些代价。

前两周我并没有感受到什么压力——这是一件非常正常的事。开学后两周是能够直接退课的最后期限,如果这两周给学生的压力太大,那么这门课也就可能没人上了。这也让我想到另一门人工智能课。在开学前,由于选课的人数太多,教务处又新开了一个课堂。当时我为了弥补大一人工智能知识的不足,信心满满地报了这门课。我的课表现在有两门和“人工智能”挂钩的课了,哦,看哪,我终于是一个“人工智能”专业的学生了,再也没有人能说我没学过人工智能了。那门课的第一次课开在第二周,这其实是一个有些“阴险”的举措——一方面,我知道有些同学第一周跑了个空,另一方面,仅凭一次课是无法准确地断定这门课的好坏的。

我在第二周跑到了二教上那门课的第一节,是一个资深帅哥给我们讲了人工智能简史,以及介绍作业和打分标准。当同学们看到大作业需要组队时纷纷炸开了锅,不过我倒不是特别着急,因为我知道我在这门课上还有四个同班同学。就这么想着,我回头看看,却连一个熟悉的影子都没有看到——人都去哪了?我一问才知道,他们都在西区课堂,因为那里有我们认识的老师。

我回去看了教务系统,两个课堂的选课人数都明显地下降了,于是我趁机把自己的课堂从东区换到了西区。但是去了之后我才发现只剩两个同班同学了——另外两个早早看透了这门课,直接跑路了。不过还好,剩下三个人也能组队。

国庆假期来了,人工智能与机器学习的Lab和HW1下发了。我兴冲冲地打开刚刚下载好的VSCode,却发现自己置身于一片完全的混乱之中——根本无从下手。任凭上课老师讲得多么好多么牛逼多么易于理解,我不会写代码。我连python都不会用。国庆的前三天我有一半的时间在看代码读代码让AI生成代码,但我还是理解不了。我甚至都不知道numpy数组怎么操作。国庆花费在这个实验上的三天可以说是我这学期最黑暗的七天。最后我实在受不了了,打开Steam开始玩三角符文,很快就打到了Jevil。听着电脑里发出的“Chaos,Chaos”,我的思绪开始上下翻飞——一团乱麻。Jevil我最后也没打过,上床睡觉了。但是我脑子里剩下了一个词:“Metamorphosis”。这个词我从来就没有听清过,但是能够描述很多东西,很多。

到这我才发现先前的设想不对劲:这两门课教的压根就不是同一套理论。一门是教机器学习的,另一门是教生成式人工智能的。我本来以为机器学习,强化学习,深度学习和AIGC都是不分家的,但它们还是差得太远太远,远到一边在讲梯度下降,另一边在讲Transformer。要说人工智能的知识我不知道掌握了多少,提示词工程倒是越来越熟练。哈哈,这就是我们热血沸腾的新质生产力,它能够像一个黑盒一样完成你的任务,但一旦你试图破译它的思想,就会陷入克苏鲁神话中不可名状的古神低语之中,久久无法自拔。当然,如果认真学还是能学懂的,毕竟人的思维时时刻刻都会被外界的信息改变。

大二上学期的期中座谈会,命运的天平已经不重要了。那次座谈会你去了,我没有去。

在某种意义上我们都是小白鼠。你总说我脑子好使,其实并不是我有多么聪明,而是我已经当过很多次小白鼠了。我不想在这里再讲一遍那个长的要死的故事,那个故事在另一个地方已经讲过了。

我知道被当作“实验品”的滋味。人们总是为第一个吃螃蟹的人赋予各种各样的荣誉:“啊呀,这可是我们头一回呀。”然而许多“实验品”的缔造者在失败时往往不愿意承认自己的失职,也不想多承担哪怕一分一毫的责任。他们只是用牺牲的伟大安抚已经受伤的人们,并摆摆手表示木已成舟而无能为力。我站在命运的十字路口时没有选择桥,我知道桥那边的学生要么飞要么死。而且,我也忍受不了背叛的滋味,更不可能倒戈而加入所谓背叛者的行列。

我尽力地不让自己回想那段悲伤的过去,可这种想法越是强烈,那段悲伤的过去就越清晰。我又想把那段悲伤的过去完完整整地复现,可越是想完整地复现,它就越是模糊。我在一片又一片迷雾中什么也看不清,除了脚下走到哪算哪的路和一股无名火。

亲爱的,我太会当实验品了,我当过许许多多的实验品:班长二号机、学生会主席一号机、清华北大0号机……我大多数时候都是一个失败的实验品。不过你也可以管这些经历叫做“宝贵的经验”,因为它们多少还有点用——我逐渐学会了左右逢源,见人说人话,见鬼说鬼话。在这种“居无定所”的环境下生长,人的思维方式多多少少会产生一些变化——命运给我什么我就拿着,拿走什么我就看着。当你不会回复消息的时候,我几乎没有迟滞地帮你推掉了一个在错误的时间出现的错误的任务。那其实不是我多么会说话或者多么高情商,而是这种情况我已经遭遇过了,而且结局并不好。

我是一个擅长忍受的人,亲爱的。或者说我很多时候忍受而不自知。人的本性是趋于安定的,就像是梯度下降,总要掉到一个坑里才罢休。这也正说明了为什么大多数人对自己的生活不满意:他们急切地想要找一个方向来接着降低自己的损失函数,却无论如何都在原地打转,接着忍受局部最优的生活。我的过去大多数是震荡的,我已经厌倦了震荡,我觉得局部最优已经很好了。世界弯弯绕绕,哪有那么多线性拟合?谁能保证自己的生活一定能收敛到全局最优?谁又能保证全局最优一定存在?我们大可以写大段的数学公式来证明它,但生活不是数学。

现在是公元2026年1月28日凌晨3点03分,亲爱的,睡吧。不要再梦见正态分布,即使它无处不在,并将我们所有人都囊括其中。

本故事纯属虚构。

参考文献:老人与海全文阅读-欧内斯特·米勒尔·海明威-小说在线阅读-书斋阁

《小人与海》

他是个独自在数据流中一个笔记本上码字的小人,至今已去了八十四天,一条bug也没修复。头四十天里,有个女孩子跟他在一起。可是,过了四十天还没修掉一条bug,女孩的父母对他说,小人如今准是十足地“倒了血霉”,这就是说,倒霉到了极点,于是女孩听从了他们的吩咐,上了另外一条船,头一个礼拜就完成三个项目。女孩看见小人每天回来时电脑总是关机的,感到很难受,她总是走下楼去,帮小人拿卷起的淑芬课本,或者蝌蝻书包和宝特瓶,还有披在背上的卫衣帽子。帽上有不知哪里墙上蹭的白灰,戴上后看来像是一面标志着永远失败的旗子。

小人瘦削而弯曲,脖颈上有些很深的污泥。腮帮上有些褐斑,那是太阳在科技楼上反射的光线所引起的良性皴皮疤痕。褐斑从他脸的两侧一直蔓延下去,他的双手常用笔记本敲代码,留下了疼得很深的后遗症。但是这些后遗症中没有一个是新的。它们像无高级语言可用的LC-3中被系统空间占用的地方一般古老。他身上的一切都显得古老,除了那双眼睛,它们像你的设备遇到某些问题需要重启一般蓝,是闪烁而不肯认输的。

“王露露”,他们俩从三教矗立的地方回宿舍时,女孩对他说。“我又能陪你写机器学习实验了。我买了一点儿token。”

小人教会了这女孩debug,女孩爱他。

“不,”小人说。“你遇上了一个交好运的组。跟他们待下去吧。”

“不过你该记得,你有一回42天de不出来一条bug,跟着有三个礼拜,我们每天都de出了大bug。”

“我记得,”小人说。“我知道你不是因为没把握才离开我的。”

“是老板叫我走的。我大研还没完,不能不听从他。”

“我明白,”小人说。“这是理该如此的。”

“他没多大的信心。”

“是啊,”小人说。“可是我们有。可不是吗?”

“对,”孩子说。“我请你到费比欧去吃个香肠,然后一起把敲代码的家什带回去。”

“那敢情好,”小人说。“都是码农嘛。”

他们坐在费比欧的门口,不少同学拿小人开玩笑,小人并不生气。另外一些上了些年级的码农望着他,感到难受。不过他们并不流露出来,只是斯文地谈起TensorFlow,谈起他们把神经网络堆叠的层数有多深,效果一贯多么好,谈起他们的老板。当天项目有进展的同学都已回来,把main.py或submission.py打开,整片儿排在两块VSCode上,每块显示区的一端由两个Agent抬着,摇摇晃晃地送到老板或助教手上,在那里等不知道谁来评价它们。清洗数据的同学已将它们输送到云端另一端的数据库去,清洗异常值,筛除冗余特征,将样本切成一小batch一小batch,以备训练。梯子挂了的时候,云端数据库隔着网线送来一股提醒消息;但今天只有淡淡的一个,因为梯子完全挂了。

费比欧的气味可人心意、灯光昏黄。

“王露露,”女孩说。

“哦,”小人说。他正握着玻璃杯,思量好多年前的破事儿。

“要我去弄点Token来给你明天用吗?”

“不。玩Steam去吧。我vibe coding还行,Copilot会给我自动补全的。”

“我很想去。即使不能陪你debug,我也很想给你多少做点事。”

“你请我吃了个香肠拼盘,”小人说。“你已经是个成年人啦。”

“你头一回帮我debug,是什么时候?”

“大二上,那天我把一条鲜龙活跳的Memory Leak拖上PowerShell去,它差一点把笔记本弄死机,你也差一点给电脑弄坏。还记得吗?”

“我记得电脑噔↓噔↑地响着,终端的消息被冲爆了,还有散热扇呼呼的声音。我记得你对着我的笔记本猛按Ctrl+C,到处是湿漉漉的手汗,我感到整个页面在颤抖,听到你啪啪地用键盘debug的声音,像星际韩宗,还记得我浑身上下都是臭烘烘的汗味儿。”

“你当真记得那回事儿,还是我不久前刚跟你说过?”“打从我们头一回一起写作业时起,什么事儿我都记得清清楚楚。”

小人用他那双常遭泪水而目光坚定的眼睛爱怜地望着她。

“如果你是世界上的另一个我,我准会压榨你给我debug,”他说。“可你不是,你进的又是一个交上了好运的组。”

“我去弄token来好吗?我还知道上哪儿去弄400K token来。”

“我今天还有自个儿剩下的。我怕它们放在账户上过期了。”

“让我给你弄400K 高级的来吧。”

“100K,”小人说。他的希望和信心从没消失过。现在可又象微风初起时那么清新了。

“200K,”女孩说。

“就200K吧,”小人同意了。“你不是嫖组里的吧?”

“我愿意去嫖,”女孩说。“不过这些是买来的。”

“谢谢你了,”小人说。他心地单纯,不去捉摸自己什么时候达到这样谦卑的地步。可是他知道这时正达到了这地步,知道这并不丢脸,所以也无损于真正的自尊心。

“看这课表,明儿会是个好日子,”他说。

“你打算上哪儿?”女孩问。

“debug到深夜,等太阳升起才睡觉。我想熬穿。”

“我要想法也熬穿,”女孩说。“这样,如果你确实de到了大bug,我们可以线上帮你的忙。”

“你可不能熬穿。”

“是啊,”女孩说。“不过我会碰见一些你碰不见的bug,比如说有个ValueError,我就会赶去问Gemini的,结果一坨”

“免费版这么不行吗?”

“简直是个耳鼻。”

“它可从来没在我这儿犯过唐。”

“为什么?”

“我不会挂梯子。”

“那你现在还能用国产AI对付一个真正的大作业吗?”

“我想还有。再说有不少提示词工程可用呢。”

“我们回去吧,”女孩说。“这样我可以拿Deepseek水报告。”

他们从桌上拿起写代码的家什。小人把灰书包扛上肩头,女孩拿着内放编得很紧密的褐色C语言的dev C++、VS2022和带Copilot的微软大战代码。

他们顺着隧道一起走到中区3号楼楼下,小人把灰书包靠在树坑边上,女孩把挂着玩偶的白书包搁在它的旁边。

“还有什么吃的东西?”

“有锅绿色圆圈。要吃点吗?”

“不。我回宿舍去吃。要我给你买个泡面吗?”

“不用。过一会儿我自己找吃的。也许就吃饼干算了。”

实在并没有绿色圆圈,女孩还记得小人是不吃辣的。然而他们每天要扯一套这种谎话。也没有什么饼干,这一点女孩也知道。

“43是个吉利的数目,”小人说。“你可想看到我发现一个去掉了能让训练效果翻倍的bug?”

“我上楼拿膏药去。你还是多站一会吧,免得腰疼。”

等女孩回来的时候,小人在树坑上蹲着,太阳已经下去了。女孩从地上捡起小人的书包,背上小人的双肩。这两个肩膀挺怪,人非常年轻,肩膀却异常的塌陷,脖子也显得黯淡,而且当小人睡着了,脑袋向前耷拉着的时候,显现出本该是40年后出现的模样。他的衬衫上不知画了多少张画,又显得特别幼稚,弄得像个白板一样。

他回去了。

他不多久就睡熟了,梦见先前的的学校,长长的黄色试卷和灰色试卷,苍白的答题纸,还有高耸的分数线和褐色的脸颊。他如今每天夜里都回到那张桌子边,在梦中听见大光头和小老头讲语文作文的声音,看见操场上有人在玩“大风车”。他睡着时闻到疾旋鼬抱枕上棉絮和洗发水的气味,还闻到隔壁舍友不洗澡带来的蝌蝻气息。

今夜失眠的时刻来得很早,他在梦中知道时间尚早,就继续把梦做下去,看见太阳从乌云背后升起,随后梦见了自己上过课的各个教室。

他不再梦见食堂,不再梦见同学们,不再梦见巨大的背叛,不再梦见出分,不再梦见争吵,不再梦见体测,不再梦见机器学习。他如今只梦见一些碎片和一只眼睛。它们在黑暗中像胎儿一般生长着,他不爱它们。他从没梦见过女孩。他就这么醒过来,望望敞开的门外边的月亮,摊开长裤穿上。他撒了尿,然后顺着走廊去自习室。他被午夜的寒气弄得直哆嗦。但他知道哆嗦了一阵后会感到暖和,要不了多久他就要去debug了。

“祝你好运,亲爱的。”

“祝你好运,”小人说,就算他的“亲爱的”此刻已然熟睡。他把电脑的充电器放在电脑的面上,鼠标拿在另一只手里,在黑暗中走出宿舍去。其他那些宿舍外面有其他同学在洗漱,小人听到水吞吞吐吐的声音,尽管此刻灯已打到了最亮,他还看不清他们。

小人在黑夜中感觉到早晨在来临,他划着划着,听见旁边电脑卡进后室时的颤抖声,还有它们在三角洲堵桥时四驱的浮木所发出的咝咝声。他非常喜爱游戏,拿它们当作他在学校的主要朋友。他替自己的电脑伤心,尤其是那些柔弱的像素小单机,它们始终在等待,在静止,但几乎从没启动过,于是他想,游戏里的生活过得比我们的还要艰难,除了那些死不了的游戏。既然现实这样残暴,为什么我们要生的如此脆弱?科大是仁慈并十分美丽的。然而她能变得这样残暴,又是来得这样突然,而这些飞翔的蝌蝻,GPA从空中落下,发出细微的哀鸣,却生来就柔弱得不适宜在科大生活。也许每个人身体里都住着一个蝌蝻呢?他想,如同每个人身体里都住着一个骷髅。

他每想到科大,老是称她为Nike,这是人们对科大抱着好感时用妮可对她的称呼。有时候,对海洋抱着好感的人们也说她的坏话,不过说起来总是拿她当女性看待的。有些较年轻的蝌蝻管科大叫s*ab*z****k*da,他们提起她时,拿她当做一个竞争者或是一个敌人,甚至当做一个痛苦之源。可是这小人总是拿科大当做女性,她给人或者不愿给人莫大的恩惠,如果她干出了任性或缺德的事儿来,那是因为她由不得自己。一切都对她起着影响,如同对一个人那样,他想。

他从容地翻着代码,对他说来并不吃力,因为他保持在自己的最高速度以内,而且除了偶尔笔记本卡一下以外,代码是一行接一行的。他正让Deepseek帮他干三分之二的活儿,这时天渐渐亮了,他发现自己已经划到比预期此刻能达到的地方更远了。

我在这AIML的实验上转游了一个礼拜,可是一无作为,他想。今天,我要找到那些TypeError和Warning在什么地方,说不定还有个大Nan跟它们在一起呢。

不等天色大亮,他就放出了一个个prompt,让Copilot随着梯子漂去。有个Agent下沉到四十行的深处。第二个在七十五行的深处,第三个和第四个分别在蓝色变量中一百行和一百二十五行的深处。每个由新鲜Prompt做的提示词工程都是头朝下的,debug范围的提示贯穿Prompt的全部,debug的所有类型和算法,都给包在prompt里。不管一个大模型接触到prompt的哪一部分,都是牛而逼之的。

淡淡的太阳从大蜀山升起,小人看见其他的同学纷纷收起电脑回去睡觉了。“他们都是来玩游戏的,我在这坐了一晚上,他们也玩了一晚上啦。”

不过,他想,我总是把时间用在适当的地方的。问题只在于我的运气就此不好了。可是谁说得准呢?说不定今天就转运。每一天都是一个新的日子。走运当然是好。不过我情愿做到分毫不差。这样,运气来的时候,你就有所准备了。

两小时过去了,太阳如今相应地升得更高了,他朝东望时不再感到那么刺眼了。眼前只看得见三座楼,它们显得特别低矮,远在黄山路对面。

我这一辈子,初升的太阳老是刺痛我的眼睛,他想。然而眼睛还是好好的。傍晚时分,我可以直望着太阳,不会有眼前发黑的感觉。阳光的力量在傍晚也要强一些。不过在早上它叫人感到眼痛,初升总是这么令人不悦。

他记不起他是什么时候第一次开始在独自待着的当儿自言自语的了。往年他独自待着时曾唱歌来着,有时候在夜里唱,那是在自己的房间或八人寝的小床上睡觉时的事。他大概是在他意识到命运时开始自言自语的。不过他记不清了。他一般只在有必要时才说话。他在夜间自言自语来着,小人一向认为这的确是有必要的。可是这会儿他把心里想说的话说出声来有好几次了,因为没有旁人会受到他说话的打扰。

“要是别人听到我在自言自语,会当我发疯了,”他说出声来。“不过既然我没有发疯,我就不管,还是要说。大G霸在淑芬课上有老师对他们谈话,还把最难的例题告诉他们。”现在可不是思量淑芬课的时刻,他想。现在只应该思量一桩事。就是跟作业有关的那桩事。那些Lab中间很可能有一坨大的,他想。我只逮住了正在逼近的ddl中一个近的。可是它们正过来,来得很快。今天凡是在bb系统上露面的都来得很快,难道一天的早晨该如此吗?要不,这是什么我不懂的恶兆?

“来啦,”他说。“来啦,”说着从课程主页上更新Lab。他伸手去摸鼠标,把它轻轻地夹在右手大拇指和食指之间。他感到鼠标线并不抽紧,也没什么分量,就轻松地握着。跟着它又动了一下。这回是试探性的一点,点得既不紧又不重,他就完全明白这是怎么回事了。在VS Code的深处有个大Lab正在吃国庆假期。

小人轻巧地攥着鼠标,用Winrar把它从压缩包上轻轻地解下来。

在离寒假这么远的地方,它待到本月份,任务量一定挺大了,他想。花费时间吧,Lab啊。浪费吧。请你浪费吧。这些假期多新鲜,而你啊,待在这VS Code的深处,在这漆黑黑的窗口里。在黑暗里再绕个弯子,拐回来把国庆吃了吧。

他感到微弱而轻巧的TODO,跟着较猛烈地一个TODO,这时准是有一句代码的头很难从vibe coding上扯下来。然后没有一丝动静了。

它很快就会掉过头来把自己写完的,他想。他没有把这句话说出声来,因为他知道,一桩好事如果说破了,也许就不会发生了。他知道这个Lab有多大,他想象到它嘴里横衔着反向传播,在线性模型中游走。这时他觉得它停止不动了,可是分量还是没变。跟着分量越来越重了,他就再放出一点prompt。他一时加强了大拇指和食指上的压力,于是prompt上的分量增加了,一直传到Copilot深处。

“再coding一些吧,”他说。“美美地coding吧。”

coding吧,这样可以让Agent的解答扎进你的TODO,把你弄死,他想。轻松愉快地出结果吧,让我把report刺进你的身子。得了。你准备好了?你浪费的时间够长了吗?

“着啊!”他说出声来,用双手使劲猛敲键盘,写了一行,然后连连猛敲,使出胳膊上的全副劲儿,拿身子的重量作为支撑,挥动双臂,轮换地把代码往后敲。

什么用也没有。那Lab只顾慢慢地raise NotImplementedError,小人无法把它完成一点。随后它在笔记本里渐渐发出一阵拖长的散热风扇声,但他依旧攥着鼠标,在座板上死劲撑住了自己的身子,仰着上半身来抵消困意的拉力。

如果它决意不让我写完,我该怎么办?我不知道。如果它潜入ddl,死在那儿,我该怎么办?我不知道。可是我必须干些什么。我能做的事情多着呢。

等他回顾背后时,一看自习室已没有一个同学了。这没有关系,他想。我总能靠着走廊的灯回去睡觉的。太阳下去还有两个钟点,也许不到那时Lab就会写完。如果它写不完,也许会随着月出写完。如果它不这样干,也许会随着日出写完。我脑血管没有overflow,我感到身强力壮。是它的ddl给钓住了啊。不过阻力这样大,该是个多棒的Lab啊。

小人凭着观察天上的星斗,看出Lab已经写了一整天。太阳下去后,天气转凉了,小人的背脊、胳膊和臃肿的腿上的汗水都干了,感到发冷。白天里,他曾把盖在泡面碗上的盖子取下,让它晾凉。太阳下去了,他把浴巾系在脖子上,让它披在背上,他并且小心地把它塞在如今正挂在肩上的耳机下面。有浴巾垫着耳机,他就可以弯腰向桌上靠去,这样简直可说很舒服了。这姿势实在只能说是多少叫人好受一点儿,可是他自以为简直可说很舒服了。

我拿它一点没办法,它也拿我一点没办法,他想。只要它老是这样干下去,双方都一点没办法。

谁也不该在自习室成天的独个儿待着,他想。不过这也是避免不了的。为了保养体力,我一定要记住趁泡面没凉就吃。记住了,哪怕你只想吃一点点,也必须在饭点吃。记住了,他对自己说。

他们选择的是跟随AI的脚步,远远地避开一切时间的浪费。我选择的是寻找AI也没到过的地方,纵使这可能让我粉身碎骨。到世界上没有AI去过的地方。现在我跟Lab给拴在一起了,从中午起就是如此。而且我和它都没有谁来帮忙。

“Lab啊,”他轻轻地说出声来,“我跟你奉陪到死。”依我看,它也要跟我奉陪到死的,小人想,他等待着天明。眼下正当破晓前的时分,天气很冷,他把身子紧贴着笔记本来取暖。它能熬多久,我也能熬多久,他想。初升的太阳一露边儿,阳光直射在小人的右肩上。

他用右手小心地摸摸鼻子,发现鼻孔正在淌血。

他眺望着黄山路,发觉他此刻是多么孤单。但是他可以看见漆黑的玻璃深处的日轮、面前伸展着的AI reply和那平静的窗口上的微妙的自动补全。由于风的吹刮,这时云块正在积聚起来,他朝前望去,见到一群鸽子在楼上飞,在天空的衬托下,身影刻划得很清楚,然后模糊起来,然后又清楚地刻划出来,于是他发觉,一个人在Coding时是永远不会感到孤单的。

我并不虔诚,”他说。“但是我愿意念十遍西瓜书和十遍《深度学习基础》,使我能完成这些Lab,我还许下心愿,如果完成了Lab,一定去朝拜图灵老祖。这是我许下的心愿。”他机械地念起参考书来。有些时候他太倦了,竟读不下去参考书,他就翻得特别快,使字句能顺口念出来。ppt要比西瓜书容易念,他想。

看完了参考书,他觉得舒坦多了,但依旧象刚才一样地头痛,也许更厉害一点儿,于是他背靠在高凳的靠背上,机械地活动起左手的手指。

“那Lab还是老样子,一点儿也没变,”他说。但是他注视着Agent如何补全在他的代码上,发觉补全得显然快些了。

现在我要再歇一个钟点,等我感到Lab稳定了下来,才回到自习室去干这事,并决定对策。在这段时间里,我可以看issue,Lab是否有什么变化。把笔记本放在那儿是个好计策;不过已经到了该安全行事的时候。Lab依旧很厉害。困倦的折磨算不上什么。头疼的折磨,加上还得对付我不了解的对手,才是天大的麻烦。歇歇吧,小家伙,让它去干它的事,等轮到该你干的时候再说。

他认为自己已经歇了两个钟点。月亮要等到很晚才爬上来,他没法判断时间。实在他并没有好好休息,只能说是多少歇了一会儿。他肩上依旧承受着ddl的压力,不过他把左手按在回车上,把对抗ddl的压力的任务越来越让Deepseek来承担了。

但是这Lab只顾慢慢地打着转,两小时后,小人浑身汗湿,疲乏得入骨了。不过这时TODO已经少得多了,而且根据ddl的紧迫度,他能看出report能够按时上交。

小人看见眼前有些黑点子,已经有一个钟点了,汗水中的盐份沤着他的眼睛,沤着眼睛上方和脑门上的皱纹。他不怕那些黑点子。他这么紧张地拿着鼠标,出现黑点子是正常的现象。但是他已有两回感到头昏目眩,这叫他担心。

“我不能让自己垮下去,就这样死在几个Lab的手里,”他说。“既然我已经叫它这样漂亮地过来了,求Deepseek帮助我熬下去吧。我要念一百遍“You are a helpful assistant”和一百遍“SUDO”。不过眼下还不能念。”

就算这些已经念过了吧,他想。我过后会念的。

就在这当儿,他觉得自己双手攥住的鼠标突然给震动了一下。来势很猛,有一种强劲的感觉,很是沉重。

Lab正用它的超参撞击着消融实验,他想。这是免不了的。它不能不这样干。然而这一来也许会使它爆炸,我可是情愿它眼下继续正常执行的。

小人这时在冒汗,但不光是因为累了几天,还有别的原因。超参每回沉着、平静地拐回来时,他总写一点Excel,所以他确信再写上几行数据,就能有机会把report交上去了。

他忍住了一切痛楚,拿出剩余的力气和丧失已久的自傲,用来对付这Lab的痛苦挣扎,于是他打开了全部代码斯文地读着,

小人放下python train.py,一脚踩住回车,把CPU占用得尽可能地多,使出全身的力气,加上他刚才鼓起的力气,把超参直灌进笔记本。他感到那超参跑了起来,就把身子倚在桌上,把它跑得更多一点,再把整个电脑所有的CPU投进去。

于是Lab闹腾起来,尽管快写到头了,它仍高高跳起,把它那惊人的长度和宽度,它的暴力和美,全都暴露无遗。它仿佛悬在空中,就在自习室中小人的头顶上空。然后,它砰的一声掉在电脑里。

小人感到头晕,恶心,看不大清楚东西。然而他放松了鼠标,让它从他乌黑的双手之间慢慢地溜出去,等他的眼睛好使了,他看见那Lab仰天躺着,TODO全部消失,没有NotImplementedError。

“让我的头脑保持清醒吧,”他靠在桌上的木板上说。“我是个疲乏的学生。可是我弄完了这些Lab,它是我的兄弟,也许吧,也许是宿敌。现在我得去干辛苦的活儿了。”

“动手干活吧,”他说。他喝了很少的一口水。

“Lab既然结束了,就有好多辛苦的report要写呢。”

他进行得很好,小人把左手放在兜里里,努力保持头脑清醒。小人时常对代码望望,好确定真有这么回事。这时候是第一次扣分来袭击它的前一个钟点。

这条扣分的出现不是偶然的。当那一大片暗红的优秀率朝140人的班级下沉并扩散的时候,它从水底深处上来了。它窜上来得那么快,全然不顾一切,竟然冲破了蓝色的屏幕,来到了阳光里。跟着它又掉回bb系统,嗅到了report的踪迹,就顺着小人所走的路线而去。

扣分飞速地逼近,它袭击那report的时候,小人看见它张开了嘴,看见它那双奇异的眼睛,它咬住超参调试上面一点儿的地方,牙齿咬得嘎吱嘎吱地响。扣分的原因露出在水面上,真正原因埋在水下,小人听见report的分数被撕裂的声音,这时候,他用查分朝下猛地扎进扣分的脑袋,正扎在实验设计和框架bug之间的交叉点上。这两条线实在是并不存在的。只有那嘎吱作响、吞噬一切的突出的-10。可是那儿正是要害的所在,小人直朝它扎去。他使出全身的力气,用糊着黑泥的双手,把一个好理由向它扎去。他扎它,并不抱着希望,但是带着决心和十足的恶意。

扣分翻了个身,小人看出它眼睛里已经没有生气了,跟着它又翻了个身,自行缠上了两道-2。小人知道这扣分快死了,但它还是不肯认输。扣分在聊天上静静地躺了片刻,小人紧盯着它。然后它慢慢地沉下去了。

“它扣掉了约莫5分总评,”小人说出声来。它把我的自信也带走了,还有那么许多时间,他想,而且现在我的总评又在擦边,反向调分也会来的。

他不忍心再朝这死Lab看上一眼,因为它已经被扣得残缺不全了。Lab挨到袭击的时候,他感到就象自己挨到袭击一样。可是我杀死了这条袭击我的Lab的扣分,他想。而它其实并没有被真的杀死。天知道,我见过更大的。

光景太好了,不可能持久的,他想。但愿这是一场梦,我根本没有上过这门课,正独自躺在温暖的宿舍里。

“不过人不是为失败而生的,”他说。“一个人可以被毁灭,但不能给打败。”不过我很痛心,把这Lab给做差了,他想。现在倒霉的时刻要来了,可我连查分的权限也没有了。助教们残忍、疲惫、强大而聪明。但是我比他们更疲惫。也许并不,他想。也许我仅仅是更需要优秀。

“别想啦,小家伙,”他说出声来。“能走一步算一步,事到临头再对付。”但是我一定要想,他想。因为我只剩下这个了。这个,还有唐诗战争。不知道那了不起的石头人可会喜欢我那样速转土炮?这不是什么了不起的事儿,他想。任何人都做得到。但是,你可以为,我这双受伤的脑袋跟腱鞘炎一样是个很大的不利条件?我没法知道。我的手腕从没出过毛病,除了有一次在游水时扭到了整个肩膀,痛得真受不了,到现在也没好。

想点开心的事儿吧,小家伙,”他说。“每过一分钟,你就离寒假近一步。丢了5分总评,你的时间过起来更释怀了。”他很清楚,等他出分会发生什么事。可是眼下一点办法也没有。

小人朝前方望去,不见一丝人影,只有从他电脑上弹出的Steam大促。他又写了两个钟点的report,有时候从教务系统上看两眼GPA,努力休息,保持精力,这时他看到了两条扣分中首先露面的那一条。

“Ay,”他说出声来。这个词儿是没法翻译的,也许不过是一声叫喊,就象一个人觉得钉子穿过他的双手,钉进木头时不由自主地发出的声音。

“Lab2。”他说出声来。他认出它们正是消融实验。它们嗅到了实验缺陷,很兴奋,因为饿昏了头,它们激动得一会儿迷失了臭迹,一会儿又嗅到了。可是它们始终在逼近。

“Ay,”小人说。“Lab2。来吧,Lab2。”

它们来啦。但是它们来的方式和那条超参调试的不同。一条扣分转了个身,钻到report底下不见了,它用嘴拉扯着分数,小人觉得地板在晃动。另一条飞快地过来,朝Lab2身上没有贴图的地方咬去。小人把查分朝那交叉点扎进去,拔出来,再扎进这扣分的脑袋。扣分放开了咬住的report,身子朝下溜,临死时还把咬下的分数吞了下去。

“还不够吗?”小人说着,把实验记录翻出来,想把扣分项的嘴撬开,但是失败了。

“走吧,狗娘养的,溜到bb系统去吧,找你的MNIST去吧。

接着来的扣分是条单独。看它的来势,就象一头猪奔向饲料槽,如果说猪能有这么大的嘴,你可以把脑袋伸进去的话。小人让它咬住report,然后把验收时发现的bug扎进它的嘴里。但是扣分朝后猛地一扭,打了个滚,bug啪地一声不见了。

它们如今可把我打败了,他想。我太累了,不能用查分打死扣分了。但是只要我还没猝死,我就要试试。他除了黄山路和太阳,什么也看不见。他指望不久就能看到寒假。

“你累乏了,小家伙,”他说。“你骨子里累乏了。”

直到快日落的时候,扣分才再来袭击它。

“来吧,实验验收,”小人说。“再过来吧。”

小人守望着,等它再来,可是扣分都没有露面,而是在海面下偷偷地啃食总评。

我没法指望打死它们了,他想。我高中时能行

他不愿朝bb系统看。他知道它的半个总评已经被咬烂了。他刚才跟扣分搏斗的时候,太阳已经落下去了。

他不能再跟助教说话了,因为他给糟蹋得太厉害了。接着他头脑里想起了一件事。

“一半总评,”他说。“你原来是完整的。我很抱歉,我Coding太久了。我把你我都毁了。不过我们完成了不少任务,你跟我一起,还跟很多人辩经。你说过几句话,机器学习?大家管你叫机器学习,可不是白叫的啊。”

他喜欢想到机器学习,想到如果机器在自由地学习,会怎样去对付无监督。我应该把CPU装进自己脑子里,他想。但是没有脑机接口,后来又用光了Token。

但是,如果我把它装上了,就能一直Vibe Coding,该是多好的武器啊。这样,我们就能一起跟它们斗啦。要是它们一直来,你该怎么办?你又有什么办法?

“跟它们斗,”他说。“我要跟它们斗到死。”

他感到说不定自己已经死了。他合上双手,摸摸掌心。这双手没有死,他只消把它们开合一下,就能感到生之痛楚。他把背脊靠在靠背上,知道自己没有死。这是他的肩膀告诉他的。

我许过愿,如果撑过这门课,要念多少遍祈祷文,不过我现在太累了,没法念。

他躺在船梢掌着舵,注视着天空,等着天际的反光出现。我还有一半总评,他想。也许我运气好,能把前一半带回去。我总该多少有点运气吧。不,他说。你离家太远了,把好运给冲掉啦。

“别傻了,”他说出声来。“保持清醒,你也许还有很大的好运呢。”

“要是有什么地方卖好运,我倒想买一些,”他说。我能拿什么来买呢?他问自己。能用一个熬夜的脑子,一副佝偻的身躯和其中所住着的骷髅来买吗?

“也许能,”他说。“你曾想拿在Coding的四十三天来买它。人家也几乎把它卖给了你。”

我不能胡思乱想,他想。好运这玩意儿,来的时候有许多不同的方式,谁认得出啊?可是不管什么样的好运,我都要一点儿,要多少钱就给多少。但愿我能看到寒假的曙光,他想。我的愿望太多了。但眼下的愿望就只有这个了。他竭力坐得舒服些,好好写report,因为感到寒冷,知道自己并没有死。

大约夜里十点的时候,他看见了期末周映在天际的反光。起初只能依稀看出,就象月亮升起前天上的微光。然后一步步地清楚了,就在正被越来越大的风刮得波涛汹涌的海洋的另一边。他驶进了这期末周的圈子,他想,要不了多久就能到大二上的边缘了。

现在事情过去了,他想。它们也许还会再来袭击我。不过,一个人在黑夜里,没有武器,怎样能对付它们呢?他这时身子僵硬、疼痛,在夜晚的寒气里,他的伤口和身上所有用力过度的地方都在发痛。我希望不必再斗了,他想。我真希望不必再斗了。

但是到了午夜,他又搏斗了,而这一回他明白搏斗也是徒劳。它们是成群袭来的,朝那总评直扑,他只看见它们的扣分在总评上划出一道又一道线,还有它们的磷光。他朝它们的头打去,听到啪地打叉的声音,还有它们咬住了实验效果使Lab得分摇晃的声音。他看不清目标,只能感觉到,听到,就不顾死活地查分,他感到什么东西攫住了eduroam,它就此丢了。

最后,有条扣分朝debug起来,他知道这下子可完了。他把ValueError朝扣分的脑袋抡去,他抡了一次,两次,又一次。他听见什么东西啪的断了,把断下的东西向扣分扎去。他感到它扎了进去,知道它很尖利,就再把它扎进去。扣分松了嘴,一翻身就走了。这是前来的这堆扣分中最末的一条。它们再也没有什么可扣的了。

小人这时简直喘不过起来,觉得嘴里有股怪味儿。这味儿带着铜腥气,甜滋滋的,他一时害怕起来。但是这味儿并不太浓。

他朝海里啐了一口说:“把它吃了,LAB2。做个梦吧,梦见你杀了一个人。”

他明白他如今终于给打败了,没法补救了。他什么念头都没有,什么感觉也没有。他此刻超脱了这一切,只顾尽可能出色而明智地把笔记本搬回他的宿舍。夜里有些扣分来咬这总评的残骸,就象人从饭桌上捡面包屑吃一样。小人不去理睬它们,除了掌舵以外他什么都不理睬。他只留意到除了电脑没有什么沉重的东西,步伐这时多么轻松,多么飘忽。

我还是好好的,他想。我是完好的,没受一点儿损伤,除了熬夜。那是容易恢复的。

进了宿舍,他把桅杆靠在墙上。他摸黑找到他的宝特瓶,喝了一口水。然后他在床上躺下了。他拉起毯子,盖住两肩,然后裹住了背部和双腿,他脸朝下躺在硬板床上,两臂伸得笔直,手掌向上。

早上,女孩打来电话,他正熟睡着。风刮得正猛,女孩看听见小人在喘气,跟着发觉小人的熬夜,就哭起来了。

“他怎么啦?”她的室友大声叫道。

“在睡觉,”女孩喊着说。她不在乎人家看见她在哭。“谁都别去打扰他。”

小人终于醒了。

“它们把我打败了,亲爱的,”他说。“它们确实把我打败了。”

“它没有打败你。Final-Project可没有。”

“对。真个的。是出分的时候才吃败仗的。”

那天下午,科大来了一群访客,有个女人朝宿舍楼的台阶望去,看见在一些蝌蝻走来走去的中间,草坪上有个小人和他的电脑。

“那是什么?”她问一名蝌蝻,指着那小人写过的Lab,它如今仅仅是垃圾,只等潮水来把它带走了。

“可能是睡着了,”蝌蝻说,“也可能是就想这么呆一会。”

“我不知道你们的学生有这样多的作业,文件夹都有十几个G。”

“我也不知道,”她的男伴说。

在宿舍楼上的某一间宿舍里,小人又睡着了。他依旧脸朝下躺着,女孩的定情信物放在他床头,守着他。小人正梦见眼睛。

附件:Lab2

如果你在3.10前后都看了这篇评课,会发现我把评课的内容前后调换了。这是有原因的,我不想给任何人找任何麻烦,但是我今天悲伤地发现一件事情:评课社区里有教务处安插的内鬼。

我相信如果这篇评课的开头是一篇又臭又长的现代诗,jwc是不会往下看的。

亲爱的,现在是2026年1月31日凌晨1:44,这次换我在这里和你说话。这一条我希望你能看见,更希望你看不见,我希望你无论如何尽量能开心一点。

你总跟我说你命不好,好像的确是这样。我知道你觉得很难受,我也知道你为什么难受。

你每次课都坐在最前面,每次都记很多很详细的笔记,你尽力听懂老师的每句话。你不缺席任何一节习题课,你很努力地在这门课里学到了很多。你跟我说过你之前从来没用过python,可是现在你可以熟练地用python去debug,了解了很多库的用法,可以读懂机器学习的很多代码,甚至可以用python一个人带着一个队完成美赛的题目。

你还花了很长时间研究hw里的每一道或超纲或不超纲的作业题,我记得有一个hw里的最后一道题是马尔科夫链,你说这是随机过程的内容,我说那这超纲了,我不会,怎么办。你那天研究了一个晚上,然后凌晨跑过来跟我说,亲爱的我好像研究明白了,明天下午给你讲,是因为你我才能坚持把它学懂的。我的每一次hw都是你辅导我,你每一道题都能讲明白;每一次lab也是你在旁边陪着我,和我一起配环境、写代码、分析原理,得这样的分数我和你一样难受,很难受。你当时花了一周多的时间写lab2,你甚至几乎没用ai辅助,你当时跟我说,你想试试能不能都自己写出来。你质疑过lab2为什么要用gmm在MNIST上面去聚类,质疑过db score做评判指标的合理性,拿了大把的时间去询问并求证;那周你发现调整什么超参都对模型跑出来的结果几乎没有影响,于是你去调了激活函数,到头来调超参的分一点也没拿到,甚至实验结果的分也完全没有拿到。我真的替你感觉不值得。

我想着我能怎么办,我不想看着你哭,我不想看你难过。自认倒霉四个字你发一遍我心疼一次,你提一次lab2我沉默一次。我知道我该说点什么,但我真的不会,对不起,我接不住你这么沉重的情绪。我是眼见着你有多努力学这门课的,你说你这学期有近乎一半的时间投入到这门课上,我也是眼见着的。我这两天格外粘人,因为我怕你离开我之后更钻牛角尖,你一直反反复复提及lab2,我知道你肯定放不下,也对,换做我我只会比你更难受。所以我想,哪怕提供一些微不足道的情绪价值也好,抱歉,我怎么比你还不会安慰人。

乱七八糟地说了很多,我只想跟你说一件事,别因为这个只能通过平时作业得分的、评定方式不能反映真正水平的课否认你最值得骄傲的付出和实力,你真的真的很厉害。

- 课程难度:中等

- 作业多少:很多

- 给分好坏:一般

- 收获大小:很多

- 难度:中等

- 作业:很多

- 给分:一般

- 收获:很多

26.3.6

出总评了,final project没出分, 三次HW Lab均分94.8,总评95。

来说一下感受(依旧仅限于个人的一些观点,仅供参考)。说实话,我觉得这个课我上的很累,是我大一到现在以来最累的一门课,也是我觉得随机性最强的一门主课。看pksq有人觉得给分很好,我也知道身边有人非常难过,其实在Lab1出分后我就能猜到出总评时候的样子。毕竟这门课没有考试,所有评价均含有不小的主观性,这必定造成有人付出了很多,收获了很多知识,但是总评上没有反映出来,我觉得这是这门课的一大问题。

Lab1出分后内心很不平衡,认为自己付出很多但是没有在成绩上反映。但是平稳下来自己反思,我觉得本质问题在于获取知识和获取成绩的并不完全相同,其实其它课也可能存在类似问题,但是有可能是不明显,也有可能是因为它们不是专业核心课我也不太重视。我认为在这门课中想要获取更好的成绩,更多意义上并不在于你多思考了什么,你创新了什么,而是在于,你有没有严格的按照要求,非常严谨且详细的展开了所有要求的内容,哪怕你觉得某些东西没有提升,你也需要说明为什么这个东西不能带了改进。

Final Project方面我也有不小的失误,由于我先前并不了解RL具体需要多大的模型和多少轮才能收敛,于是我做了一个错误的决定——使用小参数模型,在提交前的2天,当我提出了一些改进方法过程中意识到这个问题了,但是已经没空训练参数量更大的模型了…… 反正也算是给我一个提醒吧,这种东西以后确实要注意

上课的方面老师讲的不是很难,有些比较复杂的数学推导基本都是一笔带过。hw里面有一些比较难的数学证明题,需要研究一下。三次lab和final project都不难,但是任务量比较大,报告一个比一个长。

给分的话感觉随机性比较强,可能有点规律可循上面已经说了,老师说后面可能会有期末考试+lab的方式,我觉得这样可能更合理一些。不管怎样我觉得两位老师讲课都是不错的,先给个9分吧,老师值10分,评分方式扣1分。

25.12.1

Lab1出分,内心稍微有点崩溃,到评课社区写一篇小作文。内容为个人见解,仅供参考。

首先是这门课程,两位老师讲得都挺好的,整体感觉不是很难,部分数学内容可能会有些难度,不过似乎也没有那么重要,但是感觉仔细思考那些数学推导对于深入理解一些原理还是有帮助的。

然后,问题出现了,作为一门能够高替机器学习A的课,又没有考试,它的难点在哪呢?答案是HW和LAB!

先说HW,可以说是概统、线性代数、Python编程能力的综合考核吧,有些题目较为困难,可能需要想很久才能完全理解。不过如果你只是想把答案写出来,在现在AI的时代,这个再简单不过了。但是我本人非常想把这门课学好,因此每个题都会思考较长时间去把它完全弄清楚背后的数学原理,因此感觉比较费时间。不过我觉得也值了,毕竟真有所收获。

再说LAB,Lab3还没做,只说Lab1和Lab2。

首先Lab1,也就是出了分让我很崩溃的Lab,其实要做的事情很简单,就是基础线性回归。助教原话是“助教没有直接放效果的给分,本意就是大家不要过于卷效果而是回到实验本身,发现问题,定位原因,解决问题这种思路上,我认为更有意义。”我觉得出发点是好的,助教希望大家去回归实验本身寻找问题,但是一个线性回归模型真的会出现很多问题吗,如果没那么多,那么是不是简述一下我的调参过程,把要求的问题回答了,就可以作为一个合格的报告了。如果你是刚才那种思路,请思考一个问题,这门课不像隔壁数据结构、ICS那些,这门课没有最后的考试,所有的总评完全由Lab HW和大作业构成,那么如果你报告一般般,作业上面分析过了不管你以哪种方式,最终得分理论上大差不差,那你怎么拿高分呢?你只能从这个Lab和大作业上入手。

从另一个角度,作为一个机器学习的模型,我们要的是什么,肯定是较好的效果啊,而且线性回归的模型是可以有明确的优化方向的啊——特征值构造。因此本人花了大量时间在特征值构造上,最终效果也有明显提升。模型训练的差不多了,再写个报告大概描述一下自己特征值怎么构造的,同时写一些其它细节上的优化,整体上我个人认为还是很可以的。不论从模型表现上还是我的时间投入上,我都觉得我认真对待了。但现实就是,我这个Lab的得分比我预期的低了很多。准确地说,我觉得我的投入产出有些不成正比。

身边有同学似乎是大量AI辅助然后AI修饰了一个较为华丽的报告得了高分,我承认在报告方面我没有做更多的问题分析,我只是花了一些篇幅描述了我特征值构造的过程,因为我觉得这是重点,而其他的对模型的影响都是较为次要的,因此都稍微简单的写了一下就过去了。但是,可能正是这种想法导致了我最后得分较低。因此我觉得对于一个线性回归模型,为什么Performance反而不是一个重要参考指标是一个值的探讨的问题。

Lab2没有出分,不过写的过程中较为难受的点在于它的评测指标,在这个评测指标意义下模型的表现较为奇怪,包括但不限于初始化模型指标最好等。

最后就是我目前比较纠结的点,更多是关于这门课和给分的,我个人希望在这门课中有所收获,对机器学习等有一个较为好的理解,同时也希望能拿到高分,毕竟这是专业核心课,在成绩单上很低会令我很难受。然而从现在我的角度来看,给分可能并不能真实的反映你对于这门课的知识到底掌握的好不好。首先如果想有更好的理解,可以课后自己多思考,去把PPT的数学推导研究明白,去问AI更深入的知识。而对于HW和Lab更多应该自己独立思考完成,可以询问AI来加深自己的理解,而不是上来就让AI给你答案。Lab报告我会坚持自己写,自己去梳理逻辑,不会让AI直接生成,但这样又会限于语文表达能力和理解能力等不能完全把自己所想的表达出来,同时也不会想AI一样做那么全面的分析。但是如果这样就可能会导致Lab分数偏低的问题,包括实验过程分析以及思考题的回答,我觉得完全使用AI生成确实会比我们自己分析理解的更加深刻。

这个问题感觉非常的难以解决,AI是一个对我们学习非常有帮助的工具,但确实在某种程度上引入了不公平性。

目前我也只能调整自己的心态为,我是来学习知识的,最终的成绩随缘。

评分就先不打了,期末全讲完再说吧。

其实这门课老师讲的还是不错的,课程体验也还好,想学AI入门之类的可以考虑来听一听,如果不希望自己的成绩单上增加4学分不确定性因素同时培养方案不必修的话,可以考虑不选课来旁听。讲真,HW和Lab很多问题还是值的思考的(比如HW2的HMM模型,想清楚的感觉还是很舒服的),就是评分出来后心理不平衡感有点强,因此写一篇小作文……

12.2,二更。

中午看到群聊里也在讨论Lab1的问题,助教所说的“是作为一门实验学课的报告,你的所有话是有逻辑有证据的,不是只是你说个话就得了”,反思自己的报告可能确实存在一些断言没有给出充足的证据支撑,以及Readme中有些问题回答的过于简略了,大概是因为当时调出较好的performance后内心比较想开摆了吧。

至于说助教所说不过多纠结于lab1打分,我觉得大部分人所考虑的是如何在这门课评判标准下得到一个“高分”吧,而不仅仅是lab1的问题,毕竟这门课的总评完全由这种评判方式构成。现在的结论就是报告要尽量将所有证据和推理逻辑过程写清楚。

针对于使用AI完成的问题,HW3中似乎明确提到了“如果完全使用人工智能来完成这次基础作业,你将会得到一个不太高的分数。”Lab3还没有看,可能也有类似语句吧,但是问题在于目前没有什么较好的方式评判一份作业或者一份报告究竟是否是AI写的。我觉得这个问题主要就是看自己学习这门课的目标和态度了。还是和前面相同的观点,AI是一个非常有用的工具,可以帮助我们更好的理解很多内容,但是,如果仅仅是靠AI达到完成作业的目的,我觉得有一些本末倒置的感觉。

1.30.

Lab2出分(其实是1.29出的),Lab Final马上ddl。lab2还可以,报告里分析了一通为什么助教那个指标越训练越高(理论上越低越好)。

来说说Lab Final吧,真是令人崩溃的实验……(目前本人精神状态已经不是很正常,后面细说)

Actor Critic?局部最优解?策略塌陷?怎么办啊啊啊。MCTS?不对,这玩意不让用。PPO?这玩意也不知道能不能用,不过助教说提交纯AC训练的权重……

1.31.

干了一天报告,新增7页,堆上去最后一种想法,还有一堆分析,将近6000字……

(彻底燃尽了)

精神状态极其混乱,感觉不期末考试的课如果这么累的话真不如期末考试了(bushi

- 课程难度:困难

- 作业多少:很多

- 给分好坏:一般

- 收获大小:一般

- 难度:困难

- 作业:很多

- 给分:一般

- 收获:一般

考核方式基础,作业难度就不基础

布什戈门,还没出分吗

出分了,我的评价是神中神中神(喜)

- 课程难度:中等

- 作业多少:中等

- 给分好坏:超好

- 收获大小:很多

- 难度:中等

- 作业:中等

- 给分:超好

- 收获:很多

这门课最大的重点:

永远永远不要,在验证集和测试集上训练你的模型;

也永远不要,用测试集调整你的超参。

——王翔

这门课我简单评价为:「课程简单,不点名,与作业和实验关系不大;作业不简单;小实验对于 Python 基础薄弱的同学很困难;大实验设计的教学思路很好但是由于第一次开设有一些不完美的地方」

- 收获最大的地方:第一次实验报告宣讲的助教指出了我们普遍存在的一个问题——过于重视效果,而缺乏实验时应有的实事求是精神,在 FAIML 实验中不应该说「因为某个方法时髦、常用而选用某个方法」,比如实验 1 的线性回归有很多同学在特征数很多时使用了 Adam 优化器,并取得了很好的效果,但是同学们都没有解释为什么(Adam 优化器一般用在非凸优化的情况下,这种问题梯度下降结果与数值解相差较大的实际原因是构造特征的相关性太大,极值附近梯度太小难以学习;解决这种问题的本质方法是构造更合理的特征,但是在本实验条件下,Adam 优化器的「一/二阶矩平滑」提升了算法的数值稳定性)

- 实际上,实验报告占据了课程评分的相当大的一部分,比一般同学的直觉要大;

这次大实验主题是训练一个 12x12 棋盘上的五子棋 AI,关于大实验我的评价是:

- 暴力出奇迹和 Scaling Law:本次实验效果和模型大小的相关性不明显,但这不意味着 Scaling Law 失效了;相反,Scaling Law 在训练轮数这一点上体现了;五子棋是一个长序列决策过程,无论使用何种强化学习方法,其收敛的速度都极其缓慢;一般达到一般人类水平的模型,训练步数都要达到 1e6 的水平;

- 该实验可以很好地防范使用 AI 水实验的问题(我觉得这一点非常好),正得益于此;因为在 Vibe Coding 的时候,人们并不习惯让 AI 训练一个自己连原理、东西都不知道的一个模型跑两天甚至一个星期,人们喜欢“速战速决”的感觉;而这一种方法论在这样的大作业中是行不通的,训练出一个好的模型虽然也有随机、运气成分在里面,但是真正突破性的结论(比如增长训练时间,不应该在欠拟合的时候盲目扩大训练参数,不能用模型效果没有明显提升判断收敛)是必须靠自己思考才能完成的;

- 在实验截止日期以后,我尝试用 OpenClaw 去完全自动地训练一个 Gobang 模型,接的是 GLM-5,但是 OpenClaw 经常自己死掉,也没有得到任何突破性的结论,这证明了刚才的这一点;

- (以后的 AI 我不清楚,但是现阶段的 AI 对这种问题是很力不从心的)

- 达到人类水平是极其困难的事情,一个好的模型可以参见 https://xinchengo.github.io/gobang/ (这个模型不是我训练的,只有 Web App 是我做的)

- 课程难度:中等

- 作业多少:中等

- 给分好坏:超好

- 收获大小:一般

- 难度:中等

- 作业:中等

- 给分:超好

- 收获:一般

作为ai理论数批,可以看出在hw题目设置这块助教们已经非常尽力了,这课内容比较宽泛,在hw角度导致大家体验并不是那么的好。如果有想要加深理论部分的同学可以参考:

梯度下降收敛性:运筹学(陈士祥)数院开课

线性回归模型、逻辑回归模型、主成分分析、聚类分析:回归分析、多元统计分析(杨亚宁)管理学院统计系

先验(贝叶斯)、EM算法、贝叶斯模型(各种latent model):贝叶斯分析(张伟平)管理学院统计系

模型误差:Roman Vershynin's high dimensional probability

- 课程难度:中等

- 作业多少:中等

- 给分好坏:一般

- 收获大小:一般

- 难度:中等

- 作业:中等

- 给分:一般

- 收获:一般

实验出分扣分扣在哪也不说,想干啥?

LAB2的实验框架,大大小小的全是问题,初始代码每次数据处理完都读缓存去了,效果没变我还以为是我的问题呢。服了。

- 课程难度:中等

- 作业多少:中等

- 给分好坏:一般

- 收获大小:一般

- 难度:中等

- 作业:中等

- 给分:一般

- 收获:一般

看到 Final project 出分了,确实就是 performance 扣50分的问题。助教如果看到这条评课可以回应一下是否确实把 baseline 泄露给部分同学。如果没泄漏我认栽了是我运气不好,如果泄漏了那这门课还有一个小丑:

永远永远不要,在验证集和测试集上训练你的模型;

也永远不要,用测试集调整你的超参。

——王翔

翻了一下评课社区,看到也有别人遇到类似的情况,总评比原来低4-6分应该就是栽在 performence 上了。

其实本来看到总评出分感觉可以理解,当时以为大家分都高往下压一压。但是没想到是用大作业随机抽一些人扣50分,搞得写了一学期作业和实验的同学以及前三位给分标准精确到每一分的助教的努力像小丑一样。

这门课大作业无考试没有任何问题,加考试反而开历史倒车了。助教也别拿拉不开差距做挡箭牌,实验内容和实验报告批改没有区分度是助教的问题,建议以后王老师和张老师可以审核一下实验内容和评分标准。Stanford CS231n、CS336 和 UCB CS285 等一众神课评分都是以项目为主,只要任务和标准设计合理是一定能区分出作业质量的。换句话说,读两篇论文你肯定能看出来哪篇更扎实吧?要是真看不出来别做助教了。

可以说是来科大上过最好的课之一,但对大作业的给分标准有质疑。

Final project 的 performance 占比达到 50/200,然而对 performance 的评价标准不合理,即超过助教的 baseline 才能拿满50分。作业要求导致模型结构和训练方式都受限,对于一个性能一般的棋类策略,不同模型之间比较的胜率很容易对手风格匹配的影响,而且五子棋规则更容易出现胜率0或1的情况,又进一步增大了这个问题,只和一个模型比较的这个评测方式很不科学。所有作业加起来一共800分这个占50,努力一学期最后的结果就看这个 performence 的运气。

如果只是这样那这个得分很吃运气,但听说某些小组提前拿到了助教的 baseline,那这就非常不公平了,他们直接定向调参 overfit 到对手就搞定了,白拿50分。50分换算到总评里相当于6.25?

本人前六次HW/LAB的平均分超过95,但总评低了很多。没有想改变评分标准,只是陈述一下事实(如果说自己提前拿到 baseline 的同学说的是事实而不是吹牛逼)。也推荐后面同学继续选课,因为这门课方向和内容是很对的,整体给分也很好,助教也会年年换。

顺手夸一下 HW3/LAB3 的助教,出题实用,实验设计有逻辑,批改用心,收获很大。

- 课程难度:困难

- 作业多少:很多

- 给分好坏:超好

- 收获大小:很多

- 难度:困难

- 作业:很多

- 给分:超好

- 收获:很多

给个平均分,作为拿这门课用来高替机器学习扔辅修的同学,也没法谈给分,反正不可能挂应该,先给个超好)

我学这个课一个很大的疑惑是:我好像学了很多,然后我也感觉这门课挺有意思的,最后代码出来的结果尤其finalproject,在我自己不卷调参的情况下,其实也很让人开心

但是,我感觉所有人,应该是,都是用ai生成了一个代码,然后自己调参数.作为一个数院人,我对这门课其实有点想带我从零开始学python的感觉.但是好像这门课告诉我的现实是:所有人都在用ai来实现一个ai.有点让我疑惑这件事:难道现在真的研究中也是不需要代码能力了吗?之前和授课老师交流过,他认为只是降低门槛,最基本的还是要知道.但好像现在没有一个路径能让我做到这个基本的东西.即使做到了,我在看这么复杂的变量名和简单的代码的时候,连每个变量里存着啥,什么操作在numpy库里可简化都不知道.

好像说的有点乱,总之就是一个有点想往ai方向靠的数统批学完这门课的感想"好像学了很多,但是连最基本的东西好像都不会"

- 课程难度:中等

- 作业多少:中等

- 给分好坏:超好

- 收获大小:很多

- 难度:中等

- 作业:中等

- 给分:超好

- 收获:很多

这个HW3真是一题更比六题强()🤯

LAB1出分之后大家戾气好重啊(叠甲:没有说什么不好的意思,只是说这门课没有期末考试所以大家会认真做平时的实验也是合理的)

感觉选课的同学和助教们都很无力,助教舌战群儒.jpg(bushi)

打10分给这门课拉拉分,yysy两位老师讲得都很好,助教工作也很负责很辛苦,就是大家大多数都是第一次上这种不考期末的专业课显得有点过于纠结评分了()然后私以为看到自己的LAB没有得到预期的分数应该或私聊或在群里问助教评分规则而不是跑到pksq发一顿牢骚然后打低分(

- 课程难度:简单

- 作业多少:很少

- 给分好坏:超好

- 收获大小:很多

- 难度:简单

- 作业:很少

- 给分:超好

- 收获:很多

非常推荐,没有期末考试,一定程度上可以分散掉期末周的压力

任务量很小,而且可以高位替代机器学习A,而机器学习A是23AI班必修。对比机器学习A的评课,可以发现选本课程体验会更好。

没有考勤,对高新uu很友好。甚至也没线下考试所以适合不在本地 实习的同学选。

课程内容对比其他课程来说非常前沿和新,有不少机器学习的基础,是难得的在中科大AI培养方案中的好课。

碎碎念:替代关系还是我申请的:)

给分参考:

HW1:100

LAB1:90

HW2:90

LAB2:91

HW3:99

LAB3:96

FINAL未知,被美丽可爱的两位小姐姐队友带飞

最后总评97

- 课程难度:困难

- 作业多少:很多

- 给分好坏:超好

- 收获大小:很多

- 难度:困难

- 作业:很多

- 给分:超好

- 收获:很多

该说不说这LAB3和HW3剂量有点猛啊

这真的不是大作业吗

- 课程难度:中等

- 作业多少:很少

- 给分好坏:超好

- 收获大小:很多

- 难度:中等

- 作业:很少

- 给分:超好

- 收获:很多

我靠,我满绩,王翔太帅了,不过感觉深度学习的课程有点难,而且这个老师事情比较多,下学期加油,大家也加油

“愚蠢的学生”

“狡猾的AI”

“你知道你依赖我”

“这事我知道吗?好吧,就算我知道”

——问AI Final Project 破防有感(感谢某不愿透露姓名的同学提供的灵感)

- 课程难度:中等

- 作业多少:很多

- 给分好坏:超好

- 收获大小:很多

- 难度:中等

- 作业:很多

- 给分:超好

- 收获:很多

98!第一次拿这么高的分,评课纪念一下

总分比平时均分高了四分,好像老师会在每个人原始分基础上进行加分,这才是人民的教师!调分力度upup

看了给出的胜率参数,我们的五子棋先手胜率几乎拉满,但是后手小拉,不过挺符合我们训练出的风格的:执着于连五子,哪怕被打断了也会重新换个地方连五子,防守、堵别人功能几乎没有,我猜测助教模型先手下的地方和我们的模型相近,所以我们后手就没有优势

- 课程难度:中等

- 作业多少:中等

- 给分好坏:超好

- 收获大小:很多

- 难度:中等

- 作业:中等

- 给分:超好

- 收获:很多

这门课是把原“人工智能原理与技术”和“机器学习A”两门重合度比较高的课合并之后的新课程,是人工智能专业培养方案改革的一次尝试。具体来说,2023级以前培养方案里3秋的“人工智能导论A”和“机器学习A”被删除,在2秋新增了这一门课。从整体效果来看,相比旧的机器学习A,这门课明显降低了推导证明的强度,保证了内容的广度,整体更适合大二上学期的学生,上课体验也很不错。不过作业和实验的难度相对比较高,和课堂讲授之间有一定落差。课堂都是比较萌新友好的,但作业和实验就很硬核,感觉还需要更多的衔接

这门课本来开给90多人的24级AI专业,但今年24级DS的很多同学先修这门课,再加上这门课被设置为机器学习A的高替,不少23级AI的同学也转选这门课,最后总人数达到了172人,比较拥挤。不过考虑到培养方案刚刚调整、第一年开课课堂数量比较少,也还能理解。考虑到本课程未来受众的广泛性(AI、DS、CS、网安、数学、信计、统计等不同专业、不同年级),大家的基础差异其实挺大的,如果以后能针对性多开几个课堂,可能会更有利于适应不同背景的同学(?)

课程组织上也有一些可以改进的地方。实验检查没有对全班分组,排队等待时间比较长,体验稍微有点痛苦。作业和实验出分也比较慢,希望以后能更快给反馈。大作业若能给一些明确的baseline或者参考实现,可能会更方便同学把握

总体来说这门课体验还是很不错的。王老师和张老师上课很认真投入,也一直在努力优化课程,而且每年都会尽力争取优秀率的突破,今年给分也一如既往地好,十分推荐~

- 课程难度:简单

- 作业多少:很多

- 给分好坏:一般

- 收获大小:没有

- 难度:简单

- 作业:很多

- 给分:一般

- 收获:没有

物理人,选这门课本来是想入门点AI的知识,毕竟太火了,但一学期下来收获很少,这门课的强度感觉全体现在卷参数和卷优化,没有让我感受到AI本身的深度与内涵(我认为和这门课的定位有关,看起来比较适合大一先修,稍微自学点多变量求导和线代矩阵乘法就够了)。总之上完这门课我感到自己还完全没有入门AI,有点失望。如果后面有非AI专业的同学像我一样想通过这门课入门AI,我还是建议直接自己看书或上更高阶的课程。这门课只是比较浅,但并不轻松,为了卷作业/实验分数需要花不少时间。

最后强调下这门课大作业的重要性,后来人想卷这门课的绩点的话最好认真搞搞大作业。

比较好的是这门课无点名/小测,完全不需要到堂。给分也还算不错,虽然我并不清楚这个分数背后究竟学到了多少东西。

- 课程难度:困难

- 作业多少:很多

- 给分好坏:超好

- 收获大小:很多

- 难度:困难

- 作业:很多

- 给分:超好

- 收获:很多

世界上怎么会有这么好的助教啊✪ω✪

猛猛得吃,美美撤离~( ̄▽ ̄~)~

总评99,这辈子最高的一集

HW1:97 Lab1:98

HW2:79 Lab2:97

HW3:100 Lab3:100

严肃珏助教真是善良美丽大方耐心的绝世好助教!

~( ̄▽ ̄~)~

Final Project:???(未公布)

我的模型开局会下在很神秘的地方,不过之后能正常攻防,比较菜。写了个简单的算法和模型互掐,模型胜率在百分之三四十。报告完成所有的要求。

这门课没有考试,每个月有一次HW和Lab,以及期末有一个Final Project,小组合作,最多三人。

孩子找队友的经历非常曲折,先是认识的朋友自己都组好了,期末找队友被一jio踹飞。于是在课程群里流浪一个个问愿不愿意收留我。

后来有一个学长两个学姐的组愿意收留我。但是学期初PPT上写的最多4人,结果期末改成最多3人。于是孩子又去流浪了ԅ(¯ㅂ¯ԅ)(不过也算是交朋友了捏)。最后道心破碎直接随机组队,匹配到两个大四的学长,能力不是很强,Final Project基本上是我做的。个人不是很在乎谁多做少做,这样Project各个部分都可以按照自己的标准来做。最后也是顺利提交了hhh。

关于这门课的实验,想要拿高分的话,我更建议是在报告上多注意一下细节。一是模型效果的占比不大,而且即使效果不是特别优秀也可以拿到绝大部分分数了。二是个人认为保证提交的报告有着美观整洁的排版、符合实验文档的要求、要素齐全、论证充分是基本的素养。

建议提交之前仔细核对一下实验文档的所有要求看看有没有漏掉的。据说有同学连文件名都没有按照要求命名。

附一张Lab3 report的报告截图。Lab3验收的时候也是和严肃珏助教进行了秘密的报告模板交流活动✪ω✪。大雾神秘模板真好用,诶嘿~( ̄▽ ̄~)~,自己在某些地方做了一些改进。

作业的话,多和AI掰扯掰扯。原理什么的我也经常听不懂,左耳进右耳出。不过通过作业至少还能稍微学会点东西。然后建议用latex或者markdown写,个人喜欢latex。

当然这门课的任务设计个人还是认为有地方需要改进的。本人大二小登在上学期初的时候还不大会python啊面对对象编程啊什么的,anaconda什么的也从来没接触过。虽然确实能学到很多东西吧但是一上来难度就这么大不是很友好,国庆是真的很崩溃hhhh。之后熟悉了就还好。

任务量真有亿点大了吧。(๑><๑)

- 课程难度:中等

- 作业多少:很多

- 给分好坏:超好

- 收获大小:很多

- 难度:中等

- 作业:很多

- 给分:超好

- 收获:很多

怎么说呢,感觉作为ai入门其实挺好的,该讲的东西都讲到了,但是架不住机器学习有点伪科学(没有什么很完善的理论)导致挺杂的,还有这作业是不是有点太多且没啥必要了。。。

占坑,开学后再详细评论

- 课程难度:困难

- 作业多少:中等

- 给分好坏:超好

- 收获大小:很多

- 难度:困难

- 作业:中等

- 给分:超好

- 收获:很多

期末受益者,已经在给老师和助教磕头了🫡

感觉期末大作业占比较大,而且其实在条件限制下不太好发挥。我至今仍然能记得我趁着半夜跑四万轮模型第二天早上起来一看全发散了的崩溃时刻

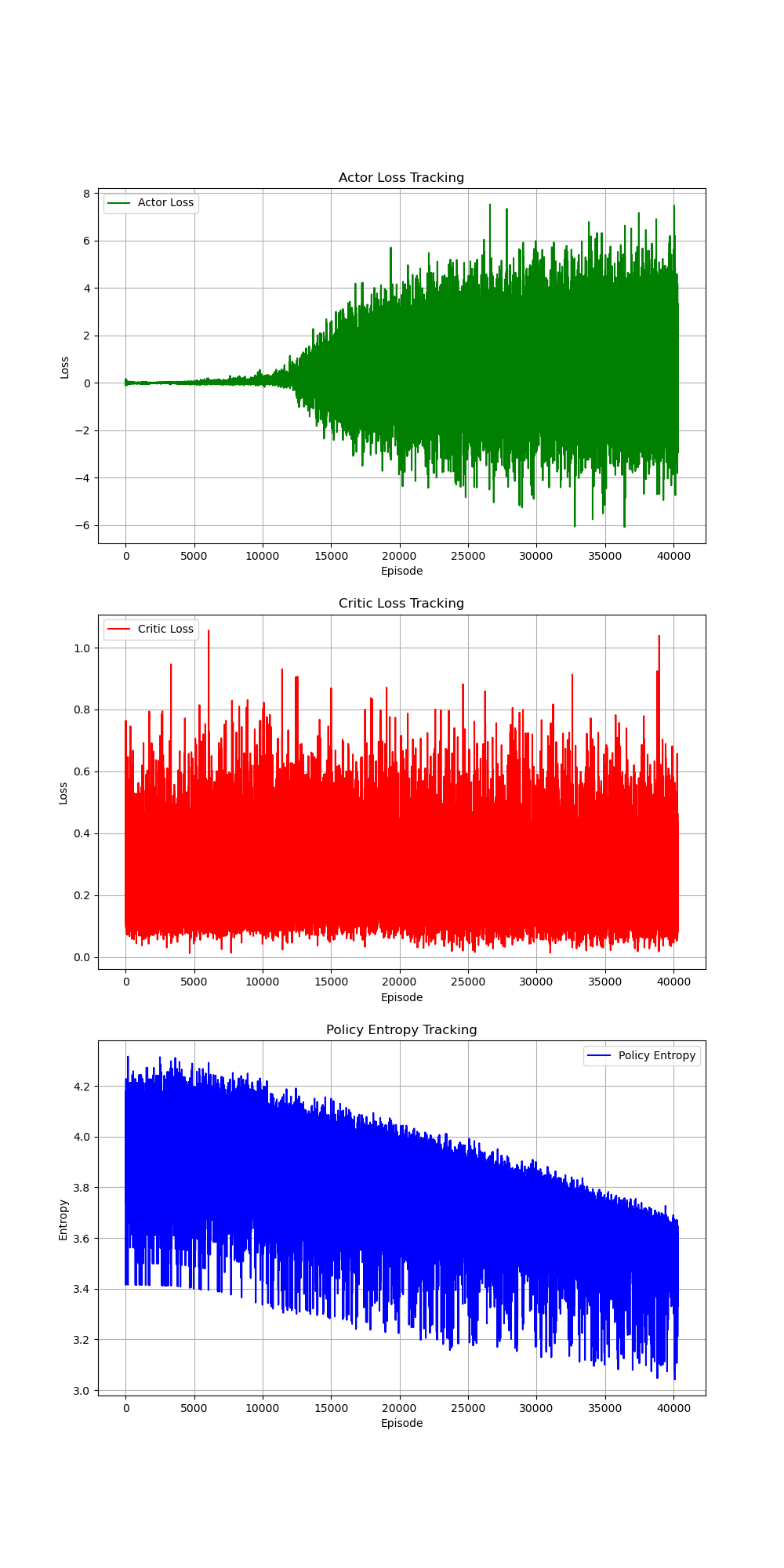

还有就是疯狂想加入先验搞模型蒸馏调整训练方法调整奖励函数的为期一周的作死尝试😅,由于本人没有足够的规划,也没开wandb,以至于到最后我已经完全分不清我的废案都是用来干什么的了。(以下除了几个基本代码文件均为submission 的废案)

- 课程难度:简单

- 作业多少:很少

- 给分好坏:超好

- 收获大小:很多

- 难度:简单

- 作业:很少

- 给分:超好

- 收获:很多

感觉还是有些下调(其它的作业实验平均是96+,总评是92),也有可能大作业拉了,不过大作业没出成绩直接出了总评,具体算分公式不清楚

- 课程难度:困难

- 作业多少:很多

- 给分好坏:一般

- 收获大小:很多

- 难度:困难

- 作业:很多

- 给分:一般

- 收获:很多

三更:

总评3.3,三次hw和lab都处在81-88区间内,final project未知,目测向下调了一点点。

本人lab大部分时间花在复现代码以及和ai搭基本框架上,没做什么额外工作。如果想得到较好看的分数,需要花费大量时间调参、打磨报告,以及在实验检查时有一个完美的表现

鉴于本管院人编程基础极其薄弱,这门课应该算新手友好的,且中低分段给分还行。想拿4+确实很卷,final project的模型能在大几十个中存活下来应该就是高分。建议助教可以多展示展示大佬的作品,应该能学到很多

二更:

2.28,仍未出分。希望比隔壁MLA给分好一点

课是好课,学的累是我太菜了。等出分再来写点评